工程师开发感知算法ADAS或完全自动驾驶通常有大量的输入数据。但这些数据,来自许多不同类型的传感器,包括雷达、激光雷达、相机、和车道探测器,最初提出的问题比解决的更多。你怎么有意义的数据,把它的生活?你如何调和矛盾的输入来自不同传感器?一旦你开发了一个算法,您如何评价结果是生产吗?

这是一个指导在MATLAB的特性和功能®和自动驾驶的工具箱™可以帮助你解决这些问题。我们将关注四个关键任务:车辆传感器数据,可视化标签地面真理,来自多个传感器的数据融合,综合测试跟踪和传感器数据融合算法。

汽车传感器数据可视化

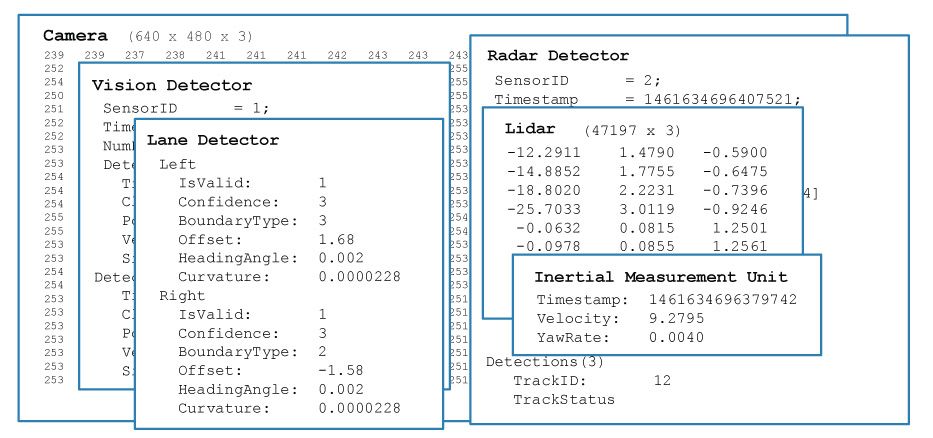

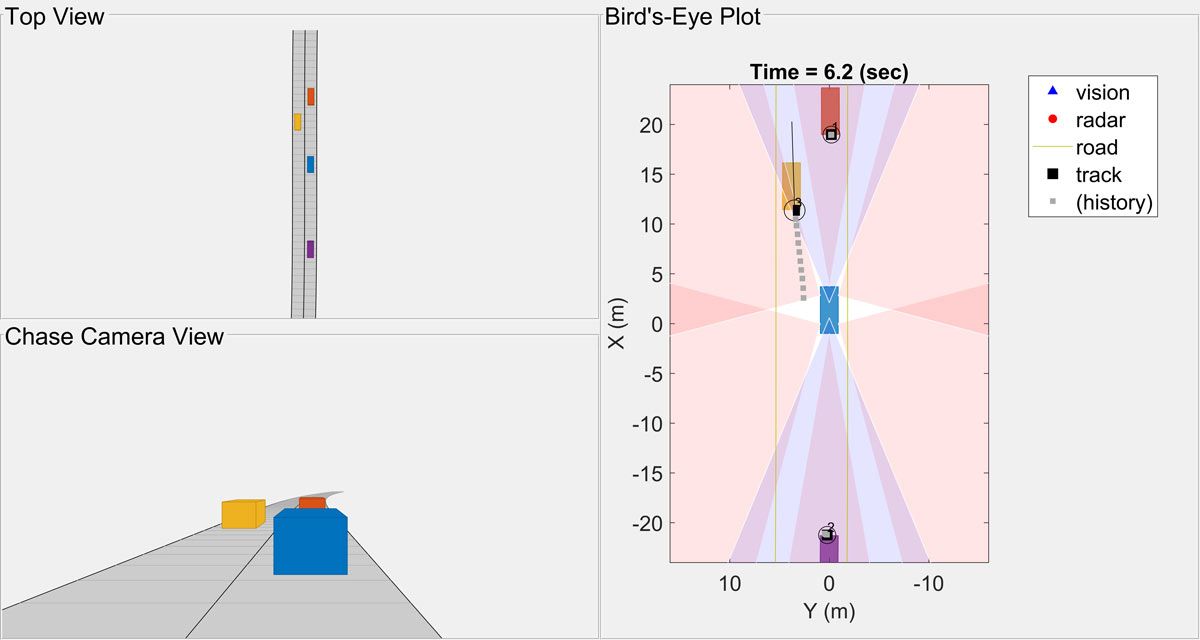

理解数据是主要的挑战在感知系统开发的早期阶段。传感器提供不同格式的输出,以不同的速率。例如,相机提供3 d图像矩阵,激光雷达提供了一个列表的点,和嵌入式智能摄像机为对象列表提供车辆细节,车道,和其他对象。这些输出的不同性质很难看到整个画面(图1)。

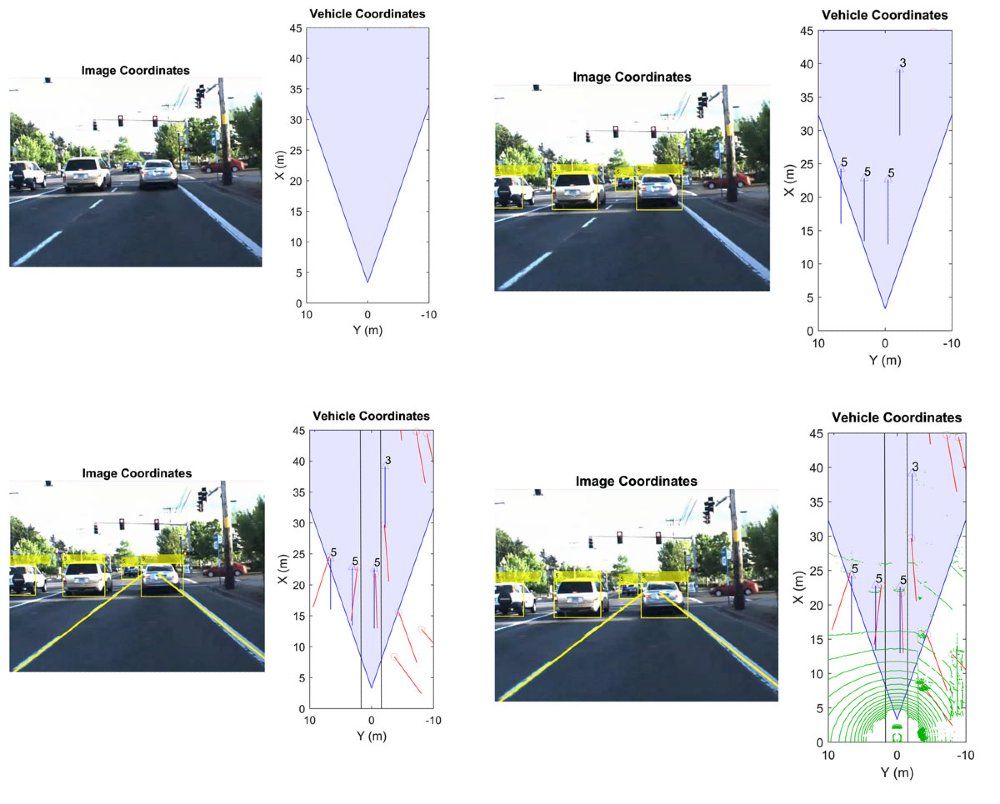

在这个早期阶段,我们需要知道如何代表车辆周围的环境的传感器。最好的类型的可视化使用这是一个鸟瞰的阴谋,因为它允许我们想象的所有数据从不同的传感器在一个地方。

创建一个情节我们使用可视化工具MATLAB和自动驾驶的工具箱。然后,我们与这些对象添加更详细的意见:

- 的

coverageAreaPlotter,它显示传感器覆盖范围 - 的

detectionPlotter,它显示列表的对象检测到视觉,雷达,激光雷达传感器 - 的

laneBoundaryPlotter,覆盖车道检测到图像

我们现在有准确的传感器覆盖,可视化检测,车道边界(图2)。

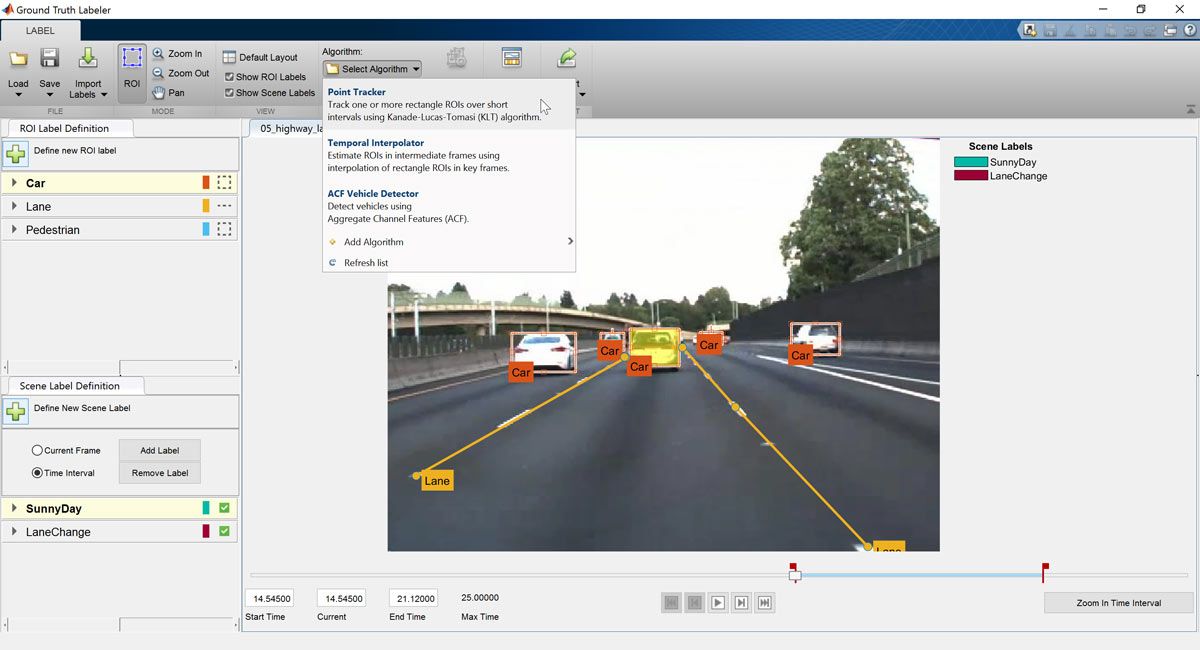

自动化地面实况标签

地面真理是需要培训对象探测器使用机器学习或深度学习技巧。它也是至关重要的,评估现有的检测算法。建立地面真理往往是一个劳动密集型的过程,要求标签必须手动插入视频,逐帧。地面真理贴标签机应用在自动驾驶工具箱包括计算机视觉算法加速标签地面真理的过程。这个应用程序有三个主要特点(图3):

- 的车辆检测器自动关键帧的检测和标签的车辆使用一个聚合通道特性(ACF)。

- 的时间内插程序标签的对象中发现所有选定的关键帧之间的帧。

- 的点跟踪器使用一个版本的Kanade-Lucas-Tomasi (KLT)算法在帧跟踪感兴趣的区域。

- 的添加算法允许您添加自定义算法和促进迭代开发的对象探测器。

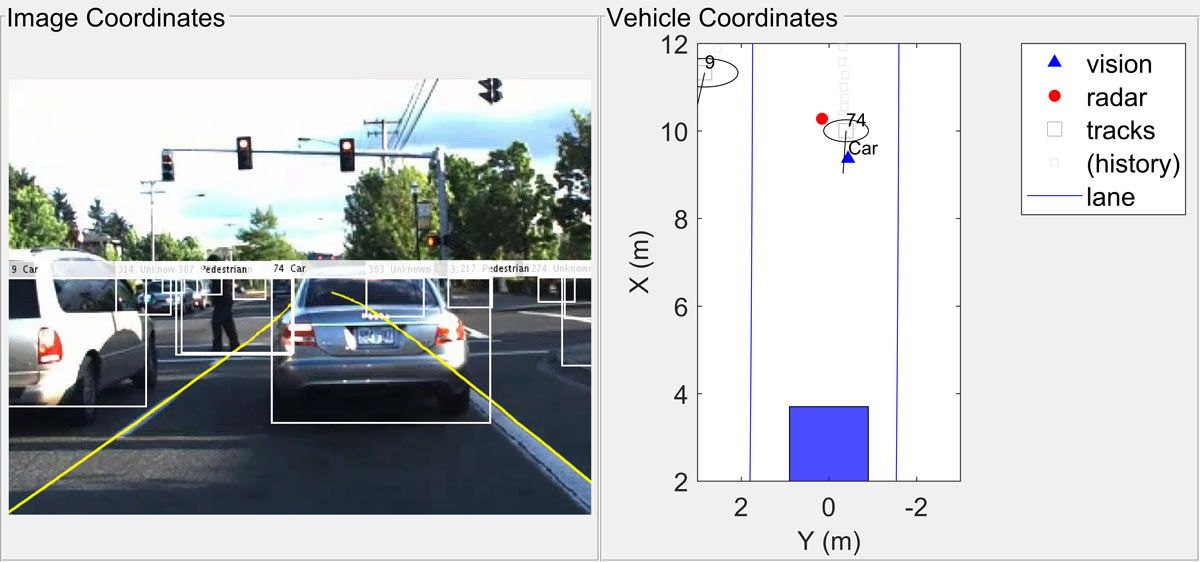

来自多个传感器的数据融合

几乎每一个知觉系统使用来自几个互补的传感器输入。协调数据从这些传感器可以是一个挑战,因为每一个可能给一个稍微不同的结果的例子,视觉上探测器可能报告说,一辆车在一个位置,而雷达探测器显示相同的车辆在附近但截然不同的位置。

的multiObjectTracker在自动驾驶的工具箱追踪和融合检测。一个常见的应用程序是融合雷达和视觉检测和改善周围车辆的估计位置(图4)。

综合传感器数据来生成测试场景

一些测试场景,比如即将碰撞,太危险的执行在实际车辆中,而其他人可能需要阴暗的天空或其他特定的天气条件。我们可以通过综合应对这一挑战对象级传感器数据生成场景,包括道路、车辆和行人作为虚拟对象。我们可以使用这个合成数据来测试跟踪和传感器融合算法。(图5)。

使用车辆数据的感知系统

可视化、融合和综合车辆数据为发展目标检测算法奠定了基础。当我们准备部署MATLAB算法,我们可以使用MATLAB编码器™生成便携,ANSI / ISO兼容的C / c++代码集成到我们的嵌入式环境。