创建马铃薯强化学习环境

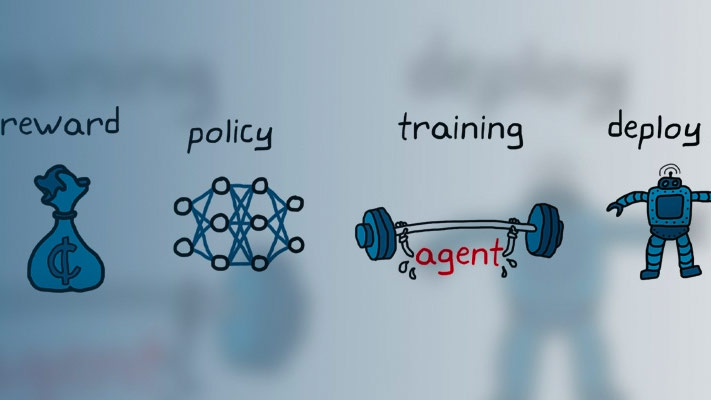

在强化学习场景中,您正在训练一个代理来完成一项任务,环境模拟代理与之交互的外部系统(即世界)。在控制系统应用中,这种外部系统通常被称为这种植物。

如下图所示,环境:

从代理接收操作。

返回响应行动的观察。

产生一种奖励来衡量行动对完成任务的贡献。

创建环境模型涉及定义:

操作和观察信号表示代理用于与环境交互。

代理用于衡量其成功的奖励信号。有关更多信息,请参阅定义奖励信号。

环境初始条件及其动态行为。

行动及观测信号

创建环境对象时,必须指定代理用于与环境交互的操作和观察信号。您可以创建离散和连续动作和观察空间。有关更多信息,请参阅rlnumericspec.和rlfinitesetspec., 分别。

您选择的信号和观察的信号取决于您的应用程序。例如,对于控制系统应用,错误信号的积分(有时导数)通常是有用的观察。此外,对于参考跟踪应用,具有时变的参考信号作为观察是有帮助的。

当您定义观测信号时,确保观察向量中包含所有环境状态(或其估计)。这是一个很好的做法,因为代理通常是缺乏内部存储器或状态的静态功能,因此它可能无法在内部成功重建环境状态。

例如,对摆锤的图像观察具有位置信息,但其本身没有足够的信息来确定摆锤的速度。在这种情况下,您可以测量或估计钟摆速度作为观察向量的额外入口。

预定义的马铃薯环境

强化学习工具箱™软件提供了一些预定义的MATLAB®在已经定义了操作,观察,奖励和动态的环境。您可以使用这些环境:

学习强化学习概念。

熟悉强化学习工具箱软件功能。

测试自己的强化学习代理。

有关更多信息,请参阅加载预定义网格世界环境和负载预定义控制系统环境。

自定义马铃薯环境

你可以为你自己的应用程序创建以下类型的自定义MATLAB环境:

具有指定大小,奖励和障碍的网格世界

使用自定义功能指定动态的环境

通过创建和修改模板环境对象指定的环境

创建自定义环境对象后,您可以以与预定义环境中相同的方式培训代理。有关培训代理商的更多信息,请参阅火车加固学习代理。

自定义网格的世界

您可以使用自己的自定义奖励,状态转换和障碍配置创建任何大小的自定义网格世界。要创建自定义网格世界环境:

创建一个网格世界模型使用

creategridworld.函数。例如,创建一个名为GW.有十行和九列。gw = creategridworld(10,9);

通过修改模型的属性来配置网格世界。例如,指定终端状态作为位置

[7,9]gw.terminalstates =“(7、9)”;网格世界需要包含在马尔可夫决策过程(MDP)环境中。为此网格世界创建MDP环境,代理用于与网格世界模型进行交互。

ent = rlmdpenv(gw);

有关自定义网格世界的更多信息,请参阅创建自定义网格世界环境。

指定自定义函数

对于简单的环境,您可以通过创建自定义环境对象rlFunctionEnv对象并指定您自己的自定义重置和步功能。

在每次训练开始时,agent调用reset函数设置环境初始条件。例如,您可以指定已知的初始状态值,或者将环境置于随机初始状态。

步骤函数定义环境的动态,即状态如何变为当前状态和代理操作。在每个训练时间步骤中,使用步函数更新模型的状态。

有关更多信息,请参阅使用自定义函数创建MATLAB环境。

创建和修改模板环境

对于更复杂的环境,您可以通过创建和修改模板环境来定义自定义环境。创建自定义环境:

使用“创建环境模板类”

rlCreateEnvTemplate函数。修改模板环境,指定环境属性,必需的环境函数和可选环境函数。

使用。验证您的自定义环境

验证环境。

有关更多信息,请参阅创建自定义MATLAB环境从模板。

也可以看看

rlCreateEnvTemplate|rlFunctionEnv|Rlpredefinedenv.