负载预定义控制系统环境

强化学习工具箱™软件提供了几种预定义的控制系统环境,用于该环境,操作,观察,奖励和动态。您可以使用这些环境:

学习强化学习概念。

熟悉钢筋学习工具箱软件功能。

测试自己的强化学习代理。

您可以加载以下预定义的MATLAB®使用该系统的控制系统环境Rlpredefinedenv.函数。

| 环境 | 代理任务 |

|---|---|

| 车杆子 | 通过使用离散或连续的动作空间将力施加到购物车上的移动电车上的平衡。 |

| 双积极商 | 使用离散或连续动作空间控制二阶动态系统。 |

| 单摆与图像观察 | 使用离散或连续的动作空间摇摆并平衡简单的钟摆。 |

您还可以加载预定义的MATLAB网格世界环境。有关更多信息,请参见加载预定义网格世界环境。

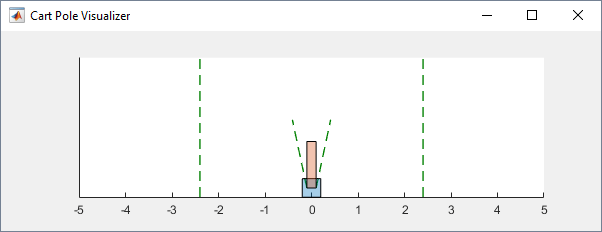

车杆环境

预定推出的推车环境中的代理的目标是通过将水平力应用于推车来平衡移动推车上的杆。如果满足以下两个条件,则杆被认为成功平衡:

极角保持在垂直位置的给定阈值内,其中垂直位置是零弧度。

推车位置的大小保持在给定阈值以下。

有两个推车杆环境变体,由代理动作空间不同。

离散 - 代理可以施加一种力量F最大要么 -F最大到购物车,在哪里F最大是

Maxiforce.环境的财产。连续代理可以在范围内应用任何力[ -F最大那F最大]。

要创建购物车环境,请使用Rlpredefinedenv.函数。

离散的动作空间

Env = Rlpredefinedenv('cartpole - 离散');连续动作空间

Env = Rlpredefinedenv('cartpole-continual');

您可以使用该方法可视化推车杆环境情节函数。绘图显示推车作为蓝色方形,杆作为红色矩形。

情节(env)

在培训期间可视化环境,请致电情节在训练之前,请保持可视化数字打开。

有关显示如何在卡车环境中培训代理的示例,请参阅以下内容:

环境属性

| 属性 | 描述 | 默认 |

|---|---|---|

重力 |

由于重力为单位的重力 | 9.8 |

马萨诸塞州 |

千克的购物车 | 1 |

马蹄菜 |

杆的质量以千克 | 0.1 |

长度 |

杆的一半长度为米 | 0.5 |

Maxiforce. |

最大水平力大小,单位为牛顿 | 10. |

TS. |

采样时间(秒) | 0.02 |

Thetathresholdradians. |

弧度的极点阈值 | 0.2094 |

Xthreshold. |

小车位置阈值(以米为单位) | 2.4 |

Remandfornotfalling. |

每次步骤奖励杆均衡 | 1 |

PenaltyForFalling |

未能平衡杆的奖励罚款 | 离散, 连续 - |

州 |

环境状态,指定为具有以下状态变量的列向量:

|

[0 0 0]' |

行动

在推车杆环境中,代理使用单个动作信号与环境相互作用,施加到推车的水平力。环境包含此动作信号的规范对象。对于环境的环境:

离散的动作空间,规范是一个

rlfinitesetspec.对象。连续动作空间,规格是一个

rlnumericspec.对象。

有关从环境中获取动作规范的详细信息,请参阅getActionInfo.。

观察

在推车系统中,代理可以观察到所有环境状态变量ent.state.。对于每个状态变量,环境包含一个rlnumericspec.观测规范。所有的状态都是连续的无界的。

有关从环境中获取观察规范的更多信息,请参阅getObservationInfo。

奖励

此环境的奖励信号由两个组件组成。

每个时间步长的正奖励是杆的平衡,即推车和杆都仍然在其指定的阈值范围内。此奖励积累了整个培训集。要控制此奖励的大小,请使用

Remandfornotfalling.环境的财产。如果杆或推车在其阈值范围之外移动,则一次性负惩罚。此时,训练集停止。要控制此惩罚的大小,请使用

PenaltyForFalling环境的财产。

双积分器环境

在预定义的双积分器环境中的代理的目标是通过应用力输入来控制二阶系统中的质量的位置。具体地,二阶系统是具有增益的双积分器。

当发生以下任一事件时,这些环境的训练剧集结束:

质量从原点开始移动,超过了给定的阈值。

状态向量的范数小于给定的阈值。

有两种双积分器环境变体,其因代理动作空间而异。

离散 - 代理可以施加一种力量F最大要么 -F最大到购物车,在哪里F最大是

Maxiforce.环境的财产。连续代理可以在范围内应用任何力[ -F最大那F最大]。

要创建双积分环境,请使用Rlpredefinedenv.函数。

离散的动作空间

Env = Rlpredefinedenv('双凝胶组 - 离散');连续动作空间

Env = Rlpredefinedenv('双凝胶组连续');

您可以使用该方法可视化双积分环境情节函数。图中显示的质量为红色矩形。

情节(env)

在培训期间可视化环境,请致电情节在训练之前,请保持可视化数字打开。

有关显示如何在Double Integrator环境中培训代理的示例,请参阅以下内容:

环境属性

| 属性 | 描述 | 默认 |

|---|---|---|

获得 |

为双积分器获得 | 1 |

TS. |

采样时间(秒) | 0.1 |

Maxdistance. |

米距离距离阈值 | 5. |

守队 |

国家范围门槛 | 0.01 |

问: |

用于奖励信号的观察组件的重量矩阵 | [10 0;0 1] |

R. |

奖励信号的动作分量的权重矩阵 | 0.01 |

Maxiforce. |

牛顿中的最大输入力 | 离散: 连续: |

州 |

环境状态,指定为具有以下状态变量的列向量:

|

[0 0) ' |

行动

在双积分器环境中,代理使用单个动作信号与环境交互,力施加到质量。环境包含此动作信号的规范对象。对于环境的环境:

离散的动作空间,规范是一个

rlfinitesetspec.对象。连续动作空间,规格是一个

rlnumericspec.对象。

有关从环境中获取动作规范的详细信息,请参阅getActionInfo.。

观察

在双积分器系统中,代理可以观察到环境状态变量ent.state.。对于每个状态变量,环境包含一个rlnumericspec.观测规范。这两个国家都是连续的,无界的。

有关从环境中获取观察规范的更多信息,请参阅getObservationInfo。

奖励

此环境的奖励信号是以下连续时间奖励的离散时间等同,这类似于LQR控制器的成本函数。

这里:

问:和R.是环境属性。X是环境状态矢量。

你是输入力。

这种奖励是整个训练集中的巨大奖励,即累积奖励。

简单的钟摆环境与图像观察

这种环境是一个简单的无摩擦摆在向下位置悬挂。培训目标是使摆锤直立,而不会使用最小的控制工作。

有两种简单的钟摆环境变量,它们因agent的行动空间而不同。

离散 - 代理可以施加扭矩

-2那-1那0.那1, 要么2到摆锤。连续代理可以在范围内施加任何扭矩[

-2那2]。

要创建一个简单的摆动环境,请使用Rlpredefinedenv.函数。

离散的动作空间

Env = Rlpredefinedenv('SimpleDequeLumwithimage-离散');连续动作空间

Env = Rlpredefinedenv('SimpleDeputulumWithimage-Continue');

有关显示如何在此环境中培训代理的示例,请参阅以下内容:

环境属性

| 属性 | 描述 | 默认 |

|---|---|---|

弥撒 |

摆锤 | 1 |

罗德长长 |

摆锤长度 | 1 |

罗蒂蒂亚 |

惯性的摆锤矩 | 0. |

重力 |

由于重力为单位的重力 | 9.81 |

阻尼比 |

在摆锤运动上阻尼 | 0. |

MaximumTorque |

Newtons中的最大输入扭矩 | 2 |

TS. |

采样时间(秒) | 0.05 |

州 |

环境状态,指定为具有以下状态变量的列向量:

|

[0 0]' |

问: |

用于奖励信号的观察组件的重量矩阵 | [1 0; 0 0.1] |

R. |

奖励信号的动作分量的权重矩阵 | 1E-3 |

行动

在简单的摆动环境中,代理使用单个动作信号与环境相互作用,施加在摆在摆的底部。环境包含此动作信号的规范对象。对于环境的环境:

离散的动作空间,规范是一个

rlfinitesetspec.对象。连续动作空间,规格是一个

rlnumericspec.对象。

有关从环境中获取动作规范的详细信息,请参阅getActionInfo.。

观察

在简单的柱形环境中,代理接收以下观察信号:

钟摆位置的50 × 50灰度图像

摆角的衍生物

对于每个观察信号,环境包含一个rlnumericspec.观测规范。所有观察结果都是连续和无界的。

有关从环境中获取观察规范的更多信息,请参阅getObservationInfo。

奖励

这种环境的奖励信号是

这里:

θT.是摆与竖直位置的位移角。

是摆角的衍生物。

你T-1是前一步的控制力。