负载预定义的金宝app环境

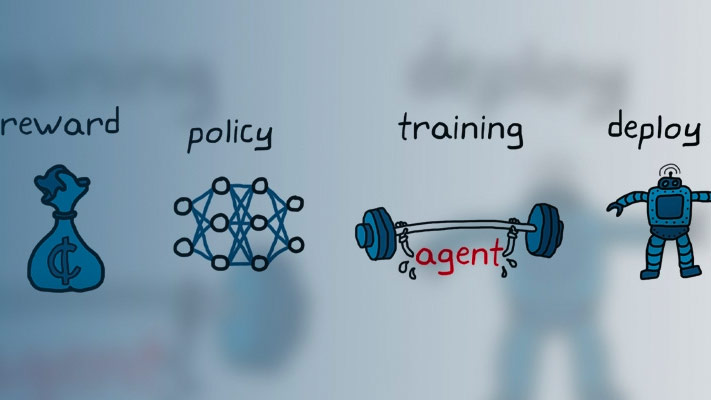

强化学习工具箱™软件提供了预定义的模型金宝app®环境的操作,观察,奖励,和动力学已经定义。您可以使用这些环境:

学习强化学习的概念。

熟悉强化学习工具箱软件功能。

测试自己的强化学习。

可以加载以下使用预定义的仿真软件环境金宝apprlPredefinedEnv函数。

| 环境 | 代理任务 |

|---|---|

| 单摆模型模型金宝app | Swing和平衡一个单摆使用一个离散的或连续的行动空间。 |

| Cart-pole Simscape™模型 | 平衡一个极动车运用部队购物车使用一个离散的或连续的行动空间。 |

对于预定义的模型环境,环境动力金宝app学,观察,并奖励信号定义在一个相应的仿真软件模型。的rlPredefinedEnv函数创建一个金宝appSimulinkEnvWithAgent对象,火车函数使用与模型交互模型。金宝app

单摆金宝app模型

这个环境是一个简单的无摩擦摆,最初挂在一个向下的位置。培训的目标是使钟摆直立而不摔倒使用最少的控制工作。这个环境中定义的模型rlSimplePendulumModel金宝app仿真软件模型。

open_system (“rlSimplePendulumModel”)

有两个单摆环境变异,不同的行动空间。

离散,代理可以应用一个力矩T马克斯,

0,或者,T马克斯钟摆,T马克斯是max_tau模型中变量的工作区。连续,代理可以应用任何扭矩范围内(-T马克斯,T马克斯]。

创建一个简单的摆环境,使用rlPredefinedEnv函数。

离散行动空间

env = rlPredefinedEnv (“SimplePendulumModel-Discrete”);持续的行动空间

env = rlPredefinedEnv (“SimplePendulumModel-Continuous”);

单摆的例子训练特工的环境,见:

行动

单摆的环境中,受托人与环境交互使用单一动作信号,扭矩应用于钟摆的基础。环境包含一个规范对象这个动作信号。对环境有:

是一个离散的行动空间,规范

rlFiniteSetSpec对象。是一个持续的行动空间,规范

rlNumericSpec对象。

更多信息获取行为规范从一个环境中,明白了getActionInfo。

观察

在单摆环境中,代理接收到以下三个观测信号,内部的构造创建的观察子系统。

摆角的正弦

摆角的余弦

导数的摆角

对于每个观测信号,包含一个环境rlNumericSpec观测规范。所有的观察都是连续和无界。

更多信息获取观测规范的环境,看看getObservationInfo。

奖励

奖励的信号环境,建造的计算奖励子系统,是

在这里:

θt是摆角直立位置的位移。

摆角的导数。

ut - 1从前面的时间步长控制的努力。

Cart-PoleSimscape模型

在预定义的目标代理cart-pole环境平衡是极对移动车通过应用水平部队购物车。极是成功地平衡如果满足下面两个条件:

极角仍然是在一个给定阈值的垂直位置,垂直位置在哪里零弧度。

车的大小位置仍低于给定的阈值。

这个环境中定义的模型rlCartPoleSimscapeModel金宝app仿真软件模型。定义使用的动力学模型Simscape多体™。

open_system (“rlCartPoleSimscapeModel”)

在环境子系统、模型动态使用Simscape定义组件和奖励和观察使用仿真软件构建块。金宝app

open_system (“rlCartPoleSimscapeModel /环境”)

有两个cart-pole环境变异,不同的代理行为空间。

离散,代理可以施加一个力

15,0,或-15年购物车。范围内的连续,代理可以施加任何力(

-15年,15]。

创建一个cart-pole环境,使用rlPredefinedEnv函数。

离散行动空间

env = rlPredefinedEnv (“CartPoleSimscapeModel-Discrete”);持续的行动空间

env = rlPredefinedEnv (“CartPoleSimscapeModel-Continuous”);

例如火车一个代理在这个cart-pole环境,明白了火车DDPG代理Cart-Pole摇摆起来,平衡系统。

行动

cart-pole环境,代理与环境交互使用单一动作信号,在车上施加的力的大小。环境包含一个规范对象这个动作信号。对环境有:

是一个离散的行动空间,规范

rlFiniteSetSpec对象。是一个持续的行动空间,规范

rlNumericSpec对象。

更多信息获取行为规范从一个环境中,明白了getActionInfo。

观察

在cart-pole环境中,代理接收以下五观察信号。

极角的正弦

极角的余弦

导数的摆角

车的位置

车位置的导数

对于每个观测信号,包含一个环境rlNumericSpec观测规范。所有的观察都是连续和无界。

更多信息获取观测规范的环境,看看getObservationInfo。

奖励

的奖励信号环境是两个组成部分的总和(r=rqr+rn+rp):

二次调节器控制奖励,构造

环境/ qr奖励子系统。车限制处罚,构成了

环境/ x限制处罚子系统。这个子系统生成一个负奖励当车位置的大小超过给定的阈值。

在这里:

x是车的位置。

θ从直立杆位移角位置。

ut - 1从前面的时间步长控制的努力。