创建金宝app强化学习的环境

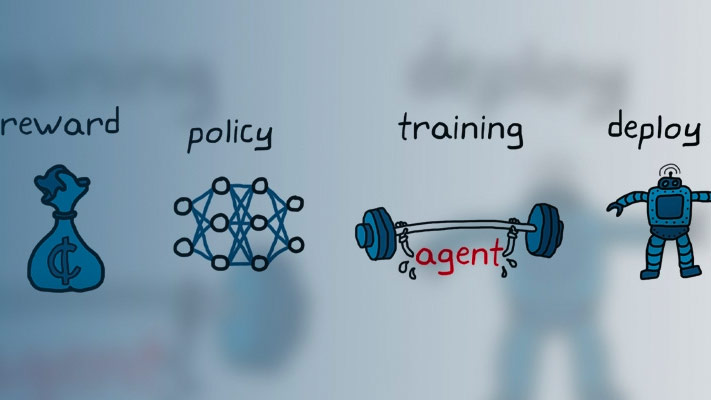

在强化学习的情况下,你训练一个代理来完成一项任务,环境模型的动态代理进行交互。如下图所示,环境:

从代理接收行为。

输出观测的行动。

生成一个奖励测量的行动有助于实现这一任务。

创建一个环境模型包括定义如下:

代理使用行动和观测信号与环境进行交互。

代理使用奖励信号来测量它的成功。有关更多信息,请参见定义奖励信号。

环境动态行为。

行动和观测信号

当你创建一个环境对象时,您必须指定代理使用的行动和观测信号与环境进行交互。您可以创建两个空间离散和连续操作。有关更多信息,请参见rlNumericSpec和rlFiniteSetSpec,分别。

你选择什么样的信号操作和观察取决于您的应用程序。例如,对于控制系统应用中,误差信号的积分(有时是衍生品)通常是有用的观察。reference-tracking应用程序,有一个时变参考信号作为一个观察是有帮助的。

当你定义你的观测信号,确保所有的系统状态可观测的观测。例如,一个图像的观察一个摆动的钟摆位置信息,但没有足够的信息来确定摆速度。在这种情况下,您可以指定摆速度作为一个独立的观察。

预定义的金宝app环境

强化学习工具箱™软件提供了预定义的模型金宝app®环境的操作,观察,奖励,和动力学已经定义。您可以使用这些环境:

学习强化学习的概念。

熟悉强化学习工具箱软件功能。

测试自己的强化学习。

有关更多信息,请参见负载预定义的仿真软件环境金宝app。

自定义金宝app环境

指定您自己的自定义强化学习环境,创建一个与一个仿真软件模型金宝appRL代理块。在这个模型中,连接操作,观察,并奖励信号RL代理块。例如,看到的水箱强化学习环境模型。

行动和观测信号,你必须创建规范对象使用rlNumericSpec连续信号和rlFiniteSetSpec对离散信号。对于总线信号,创建规范使用bus2RLSpec。

奖励的信号,构造一个标量信号的模型,并将这个信号连接到RL代理块。有关更多信息,请参见定义奖励信号。

后配置仿真软件模型,创建一个环境对象的模型使金宝app用rl金宝appSimulinkEnv函数。

如果你有一个参考模型和一个适当的行动输入端口,观察输出端口,和标量奖励输出端口,可以自动创建一个仿真软件模型,包括这个参考模型和一个金宝appRL代理块。有关更多信息,请参见createIntegratedEnv。这个函数返回环境对象,操作规范,和观察的模型。

您的环境可以包括第三方功能。有关更多信息,请参见与现有的模拟集成或环境(金宝app模型)。

另请参阅

rlPredefinedEnv|rl金宝appSimulinkEnv|createIntegratedEnv