GPU编码器

产生NVIDIA GPU的CUDA代码

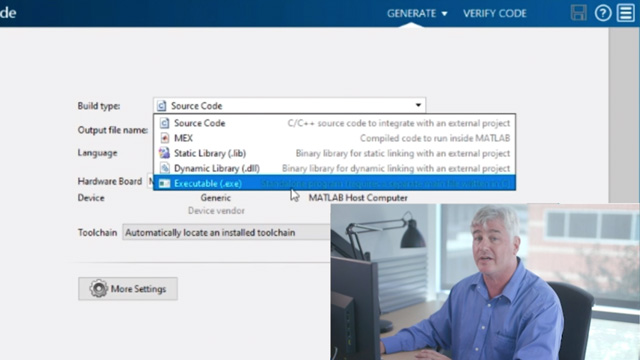

GPU编码器™生成优化的CUDA®从MATLAB代码®深学习,嵌入式视觉和自治系统的代码。所生成的代码调用优化NVIDIA®CUDA库,包括cuDNN、cuSolver和cuBLAS。它可以作为源代码、静态库或动态库集成到您的项目中,并且可以用于在gpu(如NVIDIA Tesla)上构建原型®和NVIDIA Tegra®。您可以在MATLAB中使用生成的CUDA来加速MATLAB代码的计算密集型部分。GPU编码器让您把遗留的CUDA代码合并到您的MATLAB算法和生成的代码。

与嵌入式编码器一起使用时®,GPU编码器可让您通过软件在环(SIL)测试验证生成的代码的数值行为。

开始:

部署算法免版税

编译和运行上流行的NVIDIA GPU生成的代码,从桌面系统到数据中心,嵌入式硬件。生成的代码是不收费的商业应用给你的客户就免版税的部署。

GPU编码器成功案例

了解工程师和科学家在多种行业如何利用GPU编码器来生成自己的应用程序代码CUDA。

从支持的工具箱和函数生成代码金宝app

GPU编码器从广泛的MATLAB语言生成代码的特征在于设计工程师用来开发算法作为较大系统的构件。这包括超过390运算符和函数从MATLAB和配套工具箱。

将原有的代码

使用遗留代码集成功能将可信的或高度优化的CUDA代码合并到MATLAB算法中,在MATLAB中进行测试,然后从生成的代码中调用相同的CUDA代码。

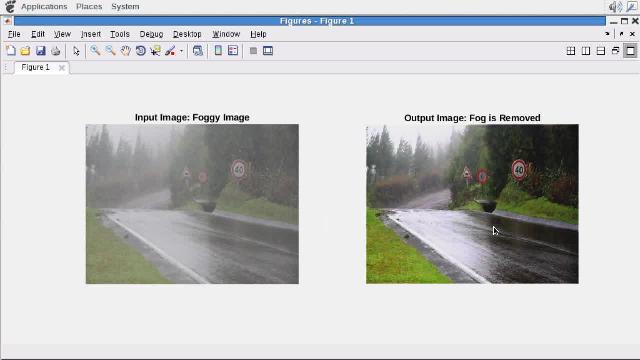

部署端到端深度学习算法

部署各种经过培训的深度学习网络,如ResNet-50和SegNet(从deep learning Toolbox™到NVIDIA gpu)。生成用于预处理和后处理的代码,以及经过训练的深度学习网络来部署完整的算法。

生成优化的推理代码

GPU编码器生成与其他深度学习解决方案相比,尺寸更小的代码,因为它只能产生与特定的算法运行推理所需要的代码。金宝搏官方网站生成的代码调用优化库,包括TensorRT™和cuDNN。

进一步优化使用TensorRT

生成的代码与NVIDIA TensorRT集成,高性能的深度学习推理的优化和运行。使用INT8或FP16数据类型额外的性能提升超过标准FP32数据类型。

最小化CPU-GPU内存传输并优化内存使用

GPU编码器自动分析,识别和的MATLAB代码分区段CPU或GPU上运行。它也最大限度地减少了CPU和GPU之间的数据副本的数量。使用分析工具,以确定其他潜在的瓶颈。

调用优化图书馆

使用GPU编码器生成的代码调用优化的NVIDIA CUDA库,包括TensorRT、cuDNN、cuSolver、cuFFT、cuBLAS和推力。只要可能,MATLAB工具箱函数生成的代码都会映射到优化的库。

样机在NVIDIA特森和DRIVE平台

使用针对NVIDIA GPU的GPU编码器支持包,将生成的代码自动交叉编译和部署到NVIDIA Jetson™和DRIVE™平台上。金宝app

访问外设和MATLAB传感器和生成的代码

通过MATLAB与NVIDIA目标进行远程通信,从网络摄像头和其他受支持的外围设备获取数据,以进行早期原型设计。金宝app构建和部署您的算法以及外围接口代码到板上,以便独立执行。

从原型转向生产

使用GPU编码器与嵌入式编码交互式跟踪您的MATLAB代码并排侧与生成CUDA。验证使用软件合环(SIL)和处理器在环(PIL)测试的硬件上运行的所生成的代码的数值行为。

加快算法使用的GPU

从您的MATLAB代码中调用生成的CUDA代码作为一个MEX函数来加速执行,尽管性能会根据您的MATLAB代码的性质而有所不同。配置文件生成了MEX函数,以识别瓶颈并集中优化工作。

cuBLAS支金宝app持

生成CUDA代码的条纹和批处理矩阵相乘

行存储阵列布局

通过在行-主布局中存储数组来简化与目标库交互生成的深度学习代码

信号处理工具箱代码生成

使用fftfilt、stft和istft生成用于基于fft的FIR滤波和短时傅里叶变换的代码

NVIDIA硬件支持金宝app

访问板载摄像头模块,并为视频阅读器功能生成CUDA代码

单镜头目标检测(SSD)网络

通过使用单杆Multibox的检测器对象上NVIDIA GPU检测

长短时记忆(LSTM)网络

产生双向的,有状态LSTM代码

多输出网络

为具有多个输出的网络生成代码

深学习网络

产生暗网-19,暗网-53,盗梦空间,RESNET-V2,NASNet-大,NASNet-Mobile的代码

看到发布说明对任何这些特征和对应的功能的详细说明。