主要内容

RL代理人

强化学习代理

- 库:

强化学习工具箱

描述

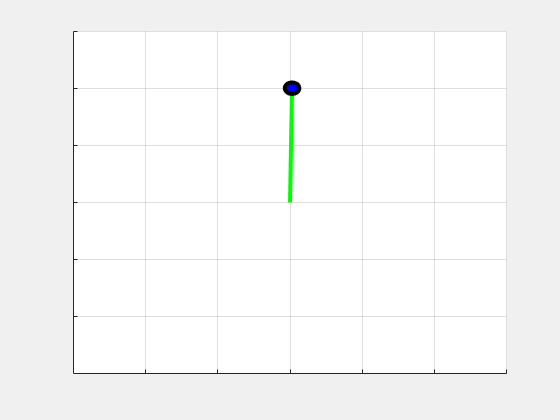

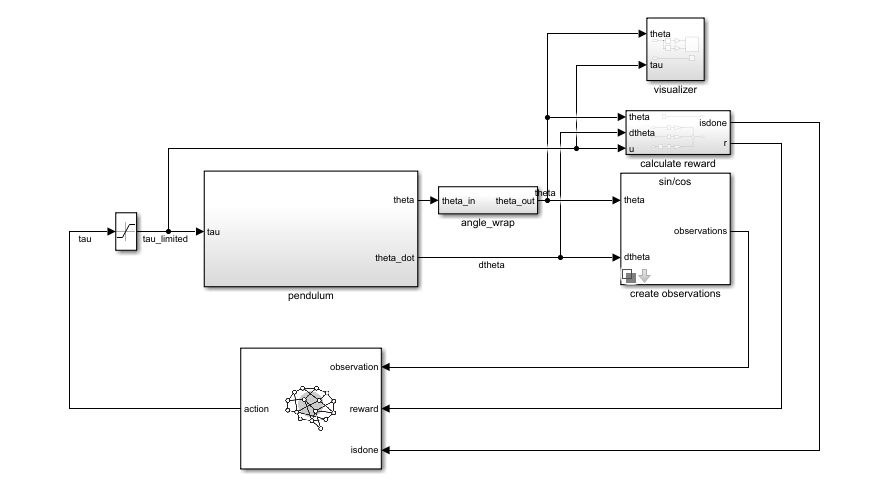

使用RL代理人模拟和培训Simulink中的加强学习代理金宝app®.您将块与存储在MATLAB中的代理相关联®工作区或数据字典作为代理对象,例如rlACAgent或者rlDDPGAgent对象。你连接这个块,让它接受一个观察和一个计算奖励。例如,考虑下面的框图Rlsimplepentulummodel.模型。

的观察输入端口RL代理人块接收由钟摆的瞬时角度和角速度得到的信号。的报酬Port将从相同的两个值和应用的操作中获得奖励。您可以配置适合您的系统的观察结果和奖励计算。

该块使用代理生成基于您提供的观察和奖励的行动。连接行动输出端口为系统适当输入。例如,在Rlsimplepentulummodel.,行动端口是施加到摆锤系统的扭矩。有关此模型的更多信息,请参阅训练DQN Agent上摆和平衡摆.

要在Simulink中训练强化学习代理,您需要从Simulink模型生成一个环境。金宝app然后创建和配置代理,以便针对该环境进行培训。有关更多信息,请参见创建Simul金宝appink强化学习环境.当你打电话火车使用环境,火车模拟模型并更新与块关联的代理。

港口

输入

输出

参数

介绍了R2019a