神经网络特性的可视化

可视化的数据和语义网络学习的内容

这篇文章来自玛丽亚Duarte罗莎,谁来讨论不同的方法学习的可视化功能网络。 今天,我们来看看两种方式来洞察网络使用两种方法:再邻居和t-SNE,我们将在下面详细描述。

使用t-SNE训练网络的可视化

数据和模型

对于这两个练习,我们将使用ResNet-18数据集,我们最喜欢的食物,你可以在这里下载。(请注意这是一个非常大的下载。我们使用这个例子的目的,因为食物是有关!这段代码应该适用于任何其他数据集你希望)。网络已经重新训练确定5类对象的数据:| 沙拉 | 披萨 | 薯条 | 汉堡 | 寿司 |

|

|

|

|

|

再邻居搜索

最近邻搜索是一种优化问题的目标是找到最接近(或最相似)点在空间中给定的点。再邻居搜索标识高级k近邻特征空间中的一个点。亲密距离度量在度量空间的一般定义是使用如欧氏距离或闵可夫斯基距离。更多的相似点,这个距离应越小。这种技术通常用于机器学习分类方法,但也可以用于可视化数据和高级特性的神经网络,这是我们要做的。让我们从5开始测试图像从食品数据集:idxTest = (394 97 996 460 737);我= imtile(字符串({imdsTest.Files {idxTest}}),“ThumbnailSize”, (100 100),“GridSize”,[1] 5日);

dataTrainFS =激活(netFood imdsTrainAu,‘数据’,‘OutputAs’,‘行’);imgFeatSpaceTest =激活(netFood imdsTestAu,‘数据’,‘OutputAs’,‘行’);dataTestFS = imgFeatSpaceTest (idxTest:);创建资讯模型和搜索最近的邻居

Mdl = createns (dataTrainFS,“距离”,“欧几里得”);idxKnn = knnsearch (Mdl dataTestFS,“k”, 10);

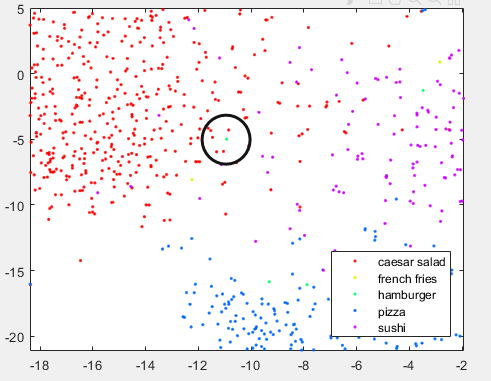

寻找相似的像素空间一般不会返回任何有意义的信息对图像的语义内容只有相似的像素强度和颜色分布。10最近的邻居的数据(像素)空间不一定对应相同的类测试图像。没有“学习”。看看第四行:

寻找相似的像素空间一般不会返回任何有意义的信息对图像的语义内容只有相似的像素强度和颜色分布。10最近的邻居的数据(像素)空间不一定对应相同的类测试图像。没有“学习”。看看第四行:dataTrainFS =激活(netFood imdsTrainAu,‘pool5’,‘OutputAs’,‘行’);imgFeatSpaceTest =激活(netFood imdsTestAu,‘pool5’,‘OutputAs’,‘行’);dataTestFS = imgFeatSpaceTest (idxTest:);创建资讯模型和搜索最近的邻居

Mdl = createns (dataTrainFS,“距离”,“欧几里得”);idxKnn (:,) = knnsearch (Mdl dataTestFS,“k”, 10);

第一列(强调)是测试图片,其余列10最近的邻居

事例:我们可以从这里学到什么?

这可以证实我们期望看到的网络,或只是另一个可视化的网络以一种新的方式。如果网络的训练精度高但最近的邻居在特征空间(假设的功能是输出的最后一层网络)不是从同一个类对象,这可能说明网络没有捕获任何语义知识相关的类,但可能已经学会分类基于训练数据的一些工件。语义聚类与t-SNE

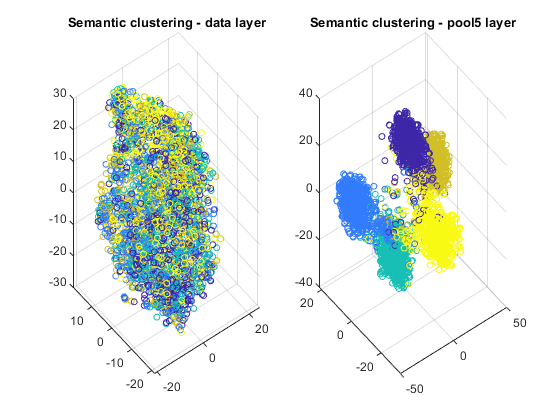

t-Distributed随机邻居嵌入(t-SNE)是一种非线性降维技术,允许嵌入低维空间的高维数据。(通常我们选择低维空间中两个或三个维度,因为这很容易情节和可视化)。这个低维空间估计在这样一种方式保存从高维空间的相似之处。换句话说,两个相似的物体附近的高概率在低维空间中,当两个不同的对象应该是由遥远的点。这种技术可用于可视化深层神经网络特性。让我们把这种技术应用到训练数据集的图像,得到一个二维和三维数据的嵌入。类似事例的示例中,我们将首先原始数据可视化(像素空间)和最终的输出平均池层。层={‘数据’,‘pool5 '};k = 1:长度(层)dataTrainFS =激活(netFood、imdsTrainAu层{k},“OutputAs”、“行”);AlltSNE2dim (:,:, k) = tsne (dataTrainFS);AlltSNE3dim (:,:, k) = tsne (dataTrainFS),“NumDimensions”, 3);图;次要情节(1、2、1);gscatter (AlltSNE2dim (:, 1, 1), AlltSNE2dim(:, 2, 1),标签);标题(sprintf(语义聚类- % s层,层{1}));次要情节(1、2、2);gscatter (AlltSNE2dim(:, 1日结束),AlltSNE2dim(:, 2,结束),标签);标题(sprintf(语义聚类- % s层,层{结束}));图; subplot(1,2,1);scatter3(AlltSNE3dim(:,1,1),AlltSNE3dim(:,2,1),AlltSNE3dim(:,3,1), 20*ones(3500,1), labels) title(sprintf('Semantic clustering - %s layer', layers{1})); subplot(1,2,2);scatter3(AlltSNE3dim(:,1,end),AlltSNE3dim(:,2,end),AlltSNE3dim(:,3,end), 20*ones(3500,1), labels) title(sprintf('Semantic clustering - %s layer', layers{end}));

图片错了语义聚类的例子

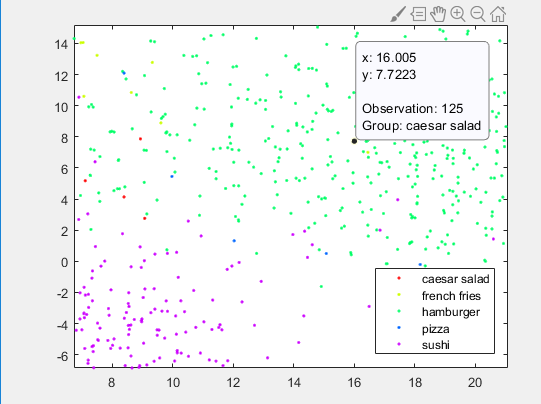

让我们仔细看看pool5的2 d图像层,和放大的一些分类错误的图像。 |

|

我= imread (imdsTrain.Files {1619});图;imshow (im)、标题(“汉堡看起来像沙拉”);

一个汉堡沙拉集群。不像其他汉堡的图片,照片中有大量的沙拉,没有面包/包。

一个汉堡沙拉集群。不像其他汉堡的图片,照片中有大量的沙拉,没有面包/包。

我= imread (imdsTrain.Files {125});图;imshow (im)、标题(“停止沙拉看起来像一个汉堡”);。 在汉堡沙拉集群。这可能是因为背景图像包含一个包子或面包。

在汉堡沙拉集群。这可能是因为背景图像包含一个包子或面包。

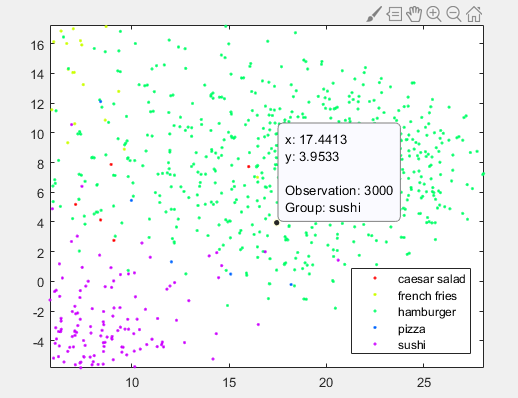

我= imread (imdsTrain.Files {3000});图;imshow (im)、标题(“寿司看起来像一个汉堡”);

版权2018年MathWorks公司。

得到了MATLAB代码

- 类别:

- 深度学习

克里夫的角落:克里夫硅藻土在数学和计算

克里夫的角落:克里夫硅藻土在数学和计算 MATLAB的博客

MATLAB的博客 史蒂夫与MATLAB图像处理

史蒂夫与MATLAB图像处理 人在仿真软件金宝app

人在仿真软件金宝app 人工智能

人工智能 开发区域

开发区域 斯图尔特的MATLAB视频

斯图尔特的MATLAB视频 在标题后面

在标题后面 文件交换的选择

文件交换的选择 汉斯在物联网

汉斯在物联网 学生休息室

学生休息室 MATLAB社区

MATLAB社区 MATLABユーザーコミュニティー

MATLABユーザーコミュニティー 创业、加速器,和企业家

创业、加速器,和企业家 自治系统

自治系统

评论

留下你的评论,请点击在这里MathWorks账户登录或创建一个新的。