最新のリリースでは,このページがまだ翻訳されていません。このページの最新版は英語でご覧になれます。

analyzeNetwork

深層学習ネットワークアーキテクチャの解析

説明

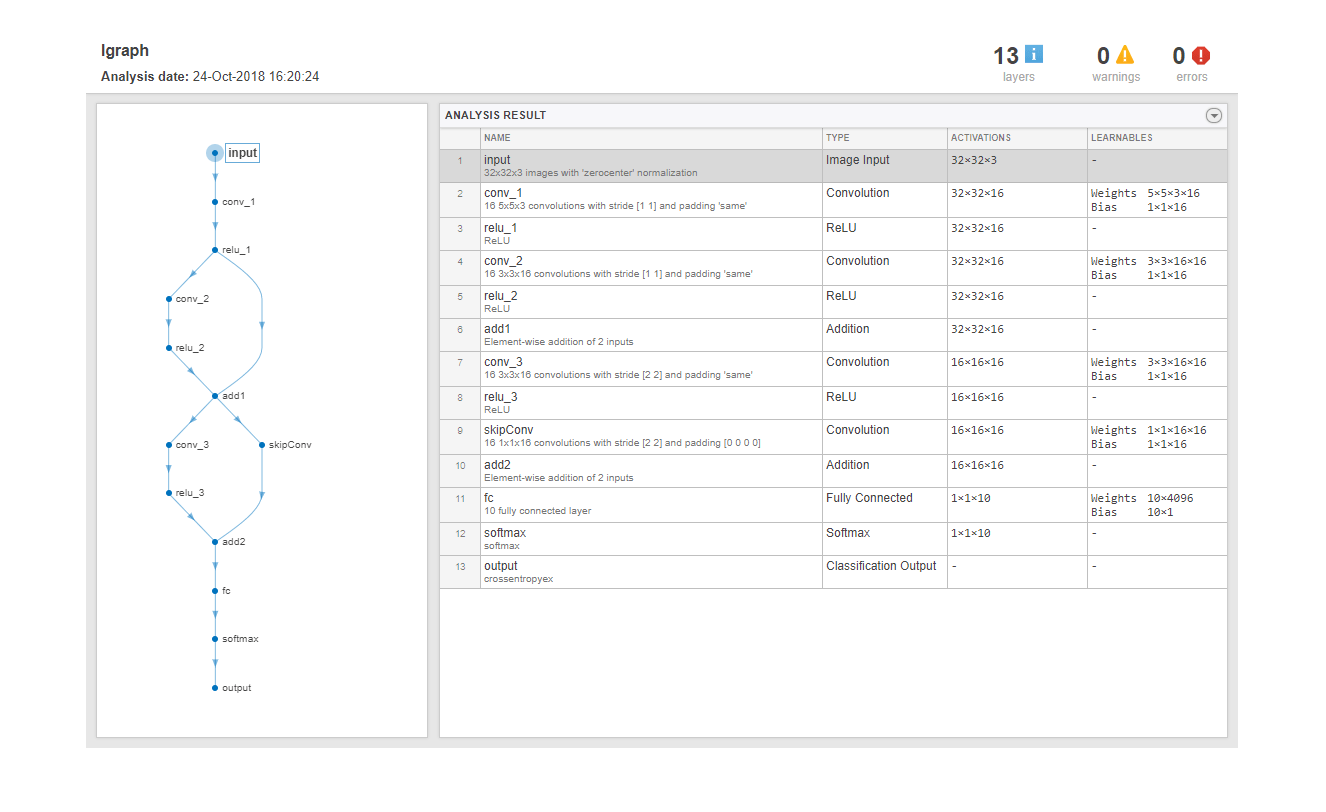

analyzeNetwork (は,层)层によって指定された深層学習ネットワークアーキテクチャを解析します。関数analyzeNetworkは,ネットワークアーキテクチャを対話的に可視化して表示し,ネットワークのエラーや問題を検出して,ネットワーク層についての詳細情報を提供します。層の情報には,層の活性化と学習可能なパラメーターのサイズ,学習可能なパラメーターの総数,および再帰層の状態パラメーターのサイズが含まれます。

ネットワークアナライザーを使用して,ネットワークアーキテクチャを可視化して把握し,アーキテクチャが正しく定義されていることを確認して,学習前に問題を検出します。analyzeNetworkが検出する問題には,層の欠損または未結合,層入力のサイズの誤り,層の入力数の誤り,無効なグラフ構造などがあります。