政策及价值功能

定义策略和值函数表示,如深度神经网络和Q表

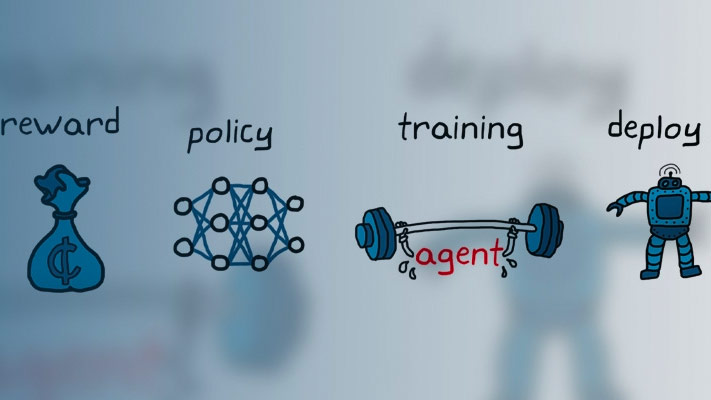

强化学习策略是一种映射,它根据对环境的观察选择要采取的行动。在培训期间,代理调整其策略表示的参数,以使长期回报最大化。

强化学习工具箱™软件为参与者和批评家表示提供了对象。参与者代表选择要采取的最佳行动的策略。批评家表示评估当前策略价值的价值函数。根据应用程序和所选代理,可以使用深度神经网络、线性基函数或查找表定义策略和值函数。有关详细信息,请参见创建策略和值函数表示.

功能

创建表示

rlValueRepresentation |

强化学习主体的价值函数批判表示 |

rlQValueRepresentation |

强化学习主体的q -值函数批判表示 |

rlDeterministicActorRepresentation |

强化学习主体的确定性行动者表示 |

rlStochasticActorRepresentation |

强化学习主体的随机行动者表征 |

rlRepresentationOptions |

为强化学习代理表示(批评者和参与者)设置的选项 |

rlTable |

值表或Q表 |

深度神经网络层

quadraticLayer |

演员或评论家网络的二次层 |

scalingLayer |

演员或评论家网络的缩放层 |

softplusLayer |

软加层演员或评论家网络 |

获取和设置代理表示

getActor |

从强化学习代理获取行动者表示 |

setActor |

设置强化学习agent的行动者表示 |

getCritic |

从强化学习主体获得批评表征 |

setCritic |

设置强化学习agent的批判表示 |

getLearnableParameters |

从策略或值函数表示中获取可学习的参数值 |

setLearnableParameters |

设置策略或值函数表示的可学习参数值 |

getModel |

从策略或值函数表示中获得计算模型 |

setModel |

设置策略或值函数表示的计算模型 |

获取动作和值函数

getAction |

从给定环境观察的agent或行动者表示中获得动作 |

getValue |

求估计值函数表示 |

getMaxQValue |

用离散动作空间求q值函数表示的最大状态值函数估计 |

主题

MATLABコマンド

次のMATLABコマンドに対応するリンクがクリックされました。

コマンドをMATLABコマンドウィンドウに入力して実行してください。WebブラウザーはMATLABコマンドをサポートしていません。

你也可以从以下列表中选择一个网站:

如何获得最佳的网站性能

请选择中国网站(中文或英文),以获得最佳网站性能。MathWorks的其他国家站点并没有针对您所在位置的访问进行优化。