RLDETerminyActorRepresentation

钢筋学习代理的确定性演员代表

描述

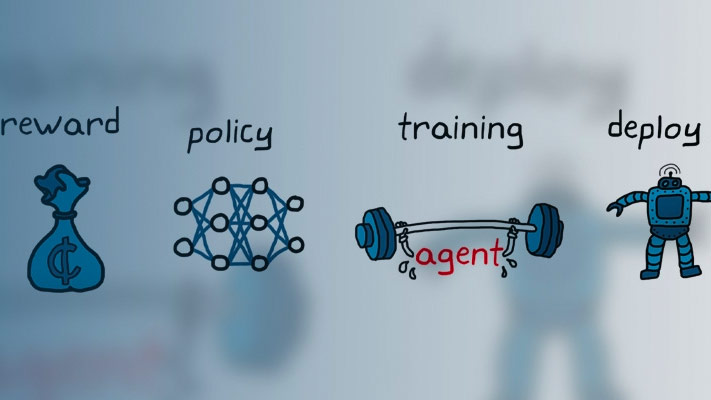

该对象实现了用作加强学习代理中的确定性actor的函数近似器。连续行动空间。确定性actor将观察结果作为输入并返回,因为输出最大化预期累积长期奖励的操作,从而实施确定性策略。创建一个RLDETerminyActorRepresentation对象,使用它来创建合适的代理,例如rlddpgagent.代理人。有关创建表示的更多信息,请参阅创建策略和值函数表示。

创造

语法

描述

演员= RLDETerministicActorRepresentation(净那观察税收那ActionInfo.,'观察',obsname.,'行动',actname.)净作为近似剂。此语法设置了观察税收和ActionInfo.属性演员对投入观察税收和ActionInfo.,包含分别观察和行动的规范。ActionInfo.必须指定连续动作空间,不支持离散操作空间。金宝appobsname.必须包含输入层的名称净与观察规范相关联。动作名称actname.必须是输出层的名称净与动作规范相关联。

演员= RLDETerminyActorRepresentation({基础FCN.那W0.},观察税收那ActionInfo.)基础FCN.到自定义基础函数,第二个元素包含初始权重矩阵W0.。此语法设置了观察税收和ActionInfo.属性演员分别到输入观察税收和ActionInfo.。

演员= RLDETerministicActorRepresentation(___那选择)选择,这是一个rlrepresentationOptions.对象。此语法设置了选择财产演员到了选择输入参数。您可以使用任何以前的Infux-Argument组合使用此语法。

输入参数

属性

对象功能

rlddpgagent. |

深度确定性政策梯度加固学习代理 |

rltd3agent. |

双延迟深度确定性政策梯度加固学习代理 |

努力 |

从代理商或演员代表获取行动给定环境观察 |