主要内容

强化学习在控制系统中的应用

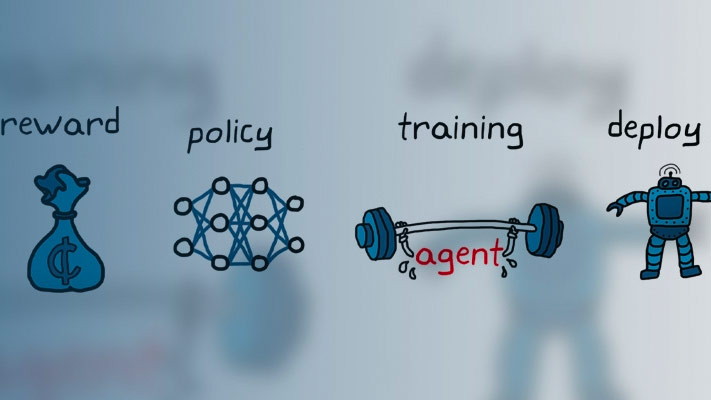

强化学习策略的行为——即策略如何观察环境并产生行动以最优方式完成任务——类似于控制系统中控制器的操作。强化学习可以通过以下映射转换为控制系统表示。

| 强化学习 | 控制系统 |

|---|---|

| 政策 | 控制器 |

| 环境 | 除了控制器之外的一切——在前面的图中,环境包括设备、参考信号和误差的计算。一般来说,环境还可以包括其他元素,例如:

|

| 观察 | 任何对agent可见的来自环境的可测量值-在上图中,控制器可以看到来自环境的错误信号。您还可以创建可以观察参考信号、测量信号和测量信号变化速率的代理。 |

| 行动 | 被操纵的变量或控制动作 |

| 奖励 | 测量、误差信号或其他性能指标的函数——例如,您可以实现奖励函数,在最小化控制努力的同时最小化稳态误差。 |

| 学习算法 | 自适应控制器的自适应机制 |

在机器人和自动驾驶等领域遇到的许多控制问题需要复杂的非线性控制架构。诸如增益调度、鲁棒控制和非线性模型预测控制(MPC)等技术可以用于解决这些问题,但通常需要控制工程师提供大量的领域专业知识。例如,增益和参数很难调整。由此产生的控制器可以提出实现挑战,如非线性MPC的计算强度。

你可以使用强化学习训练的深度神经网络来实现这种复杂的控制器。这些系统可以自学,无需专家控制工程师的干预。此外,一旦对系统进行了训练,您就可以以一种计算效率高的方式部署强化学习策略。

您还可以使用强化学习创建端到端控制器,直接从原始数据(如图像)生成操作。这种方法对于视频密集型应用程序(如自动驾驶)很有吸引力,因为您不必手动定义和选择图像特性。