火车

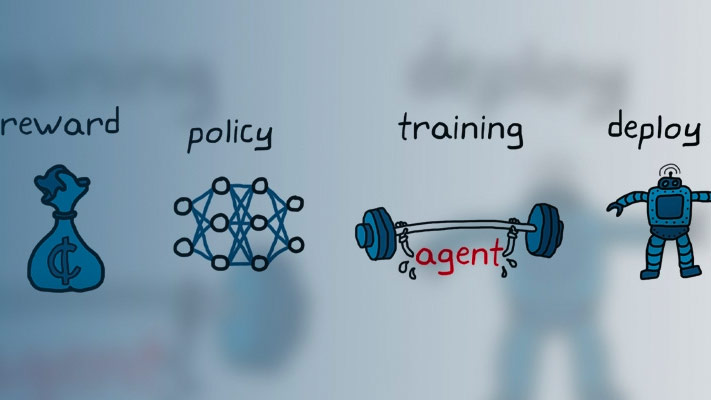

在指定环境中列车加固学习代理

描述

trainStats=火车(env那代理)代理是一个输入参数,在每次训练结束后,火车更新中指定的每个代理的参数代理使他们从环境中获得的长期回报最大化。培训结束时,代理反映了最后一集训练中每个agent的状态。

trainStats=火车(代理那env)

例子

输入参数

输出参数

提示

火车在培训进展时更新代理商。要保留原始代理参数以供稍后使用,请将代理保存到MAT文件。默认情况下,调用

火车打开Reinforcement Learning Episode Manager,它让您可视化培训的进度。《Episode Manager》情节显示了每一集的奖励、运行的平均奖励价值和评论家的估计问:0.(针对有批评者的代理商)。章节管理器还显示各种章节和培训统计数据。要关闭强化学习集管理器,请设置绘图选择trainOpts来“没有”.如果您使用一个预定义的环境,其中有一个可视化,您可以使用

情节(env)使环境形象化。如果你叫情节(env)在训练前,然后在训练中可视化更新,让你可视化每一集的进展。(对于自定义环境,您必须实现自己的环境阴谋方法。)培训在规定的条件时终止

trainOpts感到满意。若要终止正在进行的培训,请在“强化学习集管理器”中单击停止训练.因为火车在每个集中更新代理,您可以通过呼叫恢复培训火车(代理,env, trainOpts)同样,在不丢失第一次调用时学到的训练参数的情况下火车.在培训期间,您可以保存满足您指定的条件的候选代理商

trainOpts.例如,您可以保存任何集奖励超过一定值的代理,即使还未满足终止训练的总体条件。火车在指定的文件夹中的mat -文件中存储已保存的代理trainOpts.例如,已保存的代理可能有用,以允许您在长期运行培训过程中测试生成的候选代理。有关保存标准和保存位置的详细信息,请参阅rlTrainingOptions.

算法

一般来说,火车执行以下迭代步骤:

初始化

代理.对于每一次集:

重置环境。

得到最初的观察结果S.0.从环境中。

计算初始动作一种0.=μ(S.0.).

将当前操作设置为初始操作(一种←一种0.),并将当前观测值设置为初始观测值(S.←S.0.).

本集尚未结束或终止:

用行动来改善环境一种以获得下一个观察S.“至于报酬呢?R..

从经验中学习(S.那一种那R.那S.”)。

计算下一个操作一种' =μ(S.”)。

使用下一个操作更新当前操作(一种←一种')并通过下一个观察更新当前观察(S.←S.”)。

如果满足环境中定义的集终止条件,则中断。

如果训练终止条件定义

trainOpts满足条件,终止培训。否则,就开始下一集。

具体如何火车执行这些计算取决于代理和环境的配置。例如,在每一集的开始重置环境可以包括随机初始状态值,如果您配置您的环境这样做。