可辩解的人工智能

早在6月,我有幸被邀请参加MathWorks深入学习研究峰会讨论,由希瑟·高尔(https://github.com/hgorr)“可辩解的AI”多样化的组成的研究小组,从业者和各种行业专家。我想回顾一下一些讨论和提供一个地方继续对话的一个更大的听众。

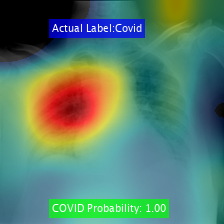

希瑟开始于一个伟大的概述和可辩解的人工智能的定义设置对话的语气:“你想知道为什么AI来到某个决定,可以从信用评分有深远的应用到自主驾驶。”

接下来从面板和观众是一系列的问题,想法,和主题:

可辩解的是什么意思?

Explainability也许有很多含义。根据定义,“解释”与推理和推理明确。但也有其他方法来思考这一项:

模型也需要理解

面临的挑战是人们不理解的系统和系统不理解的人。

我们需要系统的模型来理解和解释人类的事情。我们还需要在人类头上的系统模型。

一个例子是一个服务机器人导航空间,有一定的局限性等安全隐患(没有跑到人),电池寿命和规划路径。当有错误发生时,机器人可以解释他们的马尔可夫模型,但这并不意味着任何最终用户行走。

而非马尔可夫模型,您可能希望电脑给你们人类可读的输出。这可能会在成本系统。也许这减缓了系统,还是昂贵的建造由于UI生成输出。

提问:您可能想问系统某些问题的验证结果:

模型也需要理解

面临的挑战是人们不理解的系统和系统不理解的人。

我们需要系统的模型来理解和解释人类的事情。我们还需要在人类头上的系统模型。

一个例子是一个服务机器人导航空间,有一定的局限性等安全隐患(没有跑到人),电池寿命和规划路径。当有错误发生时,机器人可以解释他们的马尔可夫模型,但这并不意味着任何最终用户行走。

而非马尔可夫模型,您可能希望电脑给你们人类可读的输出。这可能会在成本系统。也许这减缓了系统,还是昂贵的建造由于UI生成输出。

提问:您可能想问系统某些问题的验证结果:

-

- 可辩解的可能意味着可说明的。

- 事实上,可解释性甚至可能比explainability更重要:如果设备给一个解释,我们可以解释它的上下文中我们试图实现什么?例如,一个数学公式或决定在符号形式假定用户的一些知识,这些公式和符号是什么意思。

- 可辩解的可能意味着可说明的。

-

- 另一个关键术语的概念抽象我们需要多少的一个解释?

- 例如,如果您正在使用一个神经网络,你需要了解每个节点结束时发生了什么?在每一层的终结吗?在分类层?

- 谁是你的观众:他们是一个经理吗?他们是一个工程师吗?他们是最终用户吗?如果你是一个工程师试图给花费公司预算的原因,你需要找到一个方法来解释一个经理在这一水平。是有区别的两位科学家有一个谈话和一个科学家和一个随机的人在一个单独的字段。

- 另一个关键术语的概念抽象我们需要多少的一个解释?

Explainability是需要一个“模型”来验证你的发展。一起工作和维护信任,人类需要一个“模型”的电脑在做什么,一样的电脑需要一个“模型”的人在做什么。

- “你想做什么,你的目标是什么?”

- “你为什么要决定这个特定的决定?”

- “合理的替代方案是什么,为什么这些拒绝吗?”

- 风险与信心:如果我有信心的结果,我想要看到的解释的可能性有多大?我们使用风险和信心在我们的日常生活。例如,映射软件像谷歌地图——我们不知道为什么这个算法是指导人们这样或那样的方式。书建议的另一个例子是一个低风险的预测。最坏的事情是什么,如果这个推荐系统是错误的吗?

- 如果一个神经网络工作100%的时间有100%的信心,我们真的关心解释能力吗?

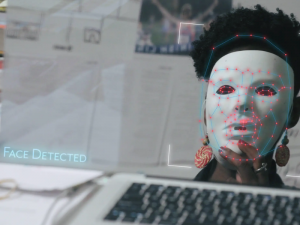

- 讨论explainability不同行业和行业之间无比。

- 金融、航空航天、自动驾驶之间的关系。这些都将有不同的要求。

- 安全比explainability更重要。导致另一个吗?

- 关于高等教育:如果我们不能解决这个问题的explainability AI,我们最终将博士生教育,只知道如何训练神经网络盲目不知道为什么他们的工作(或为什么他们不。)

- 在某些应用程序中,尤其是安全至关重要,验证过程的一部分将人们试图打破它。

- 这包括测试数据如假输入数据被混淆一个系统,可以得到不正确的结果。

- 测试网络:如果一个模型提出了一些完全陌生而不是原始数据集?该系统将如何应对?

- 一个系统如何“忘却”错误的决定?作为人类我们可以说“这一决定不再适合我,我固有的决策不是工作。”

- 遗忘是人类和机器的难题。你如何使你的AI忘掉一些东西如果你不知道为什么/如何学习呢?

- 的一个例子,一个网络可能胜过人类的肌肉记忆。例如,美国行人本能地学会过马路之前,先向右看。网络没有这种“肌肉记忆”,可以训练学习的规则一定地区的世界。

- 我们可以当我们试图使用敌对的网络不学习方面的一个图像?

- 网络应该是定义良好的任务,他们会遇到什么。如果我们继续我们的网络透明(训练数据和网络架构是透明的)和作用一个定义明确的问题,这可以消除错误。

- 类别:

- 深度学习

克里夫的角落:克里夫硅藻土在数学和计算

克里夫的角落:克里夫硅藻土在数学和计算 MATLAB的博客

MATLAB的博客 史蒂夫与MATLAB图像处理

史蒂夫与MATLAB图像处理 人在仿真软件金宝app

人在仿真软件金宝app 人工智能

人工智能 开发区域

开发区域 斯图尔特的MATLAB视频

斯图尔特的MATLAB视频 在标题后面

在标题后面 文件交换的选择

文件交换的选择 汉斯在物联网

汉斯在物联网 学生休息室

学生休息室 MATLAB社区

MATLAB社区 MATLABユーザーコミュニティー

MATLABユーザーコミュニティー 创业、加速器,和企业家

创业、加速器,和企业家 自治系统

自治系统

评论

留下你的评论,请点击在这里MathWorks账户登录或创建一个新的。