主要内容

政策和价值功能

定义策略和值函数表示,如深度神经网络和Q表

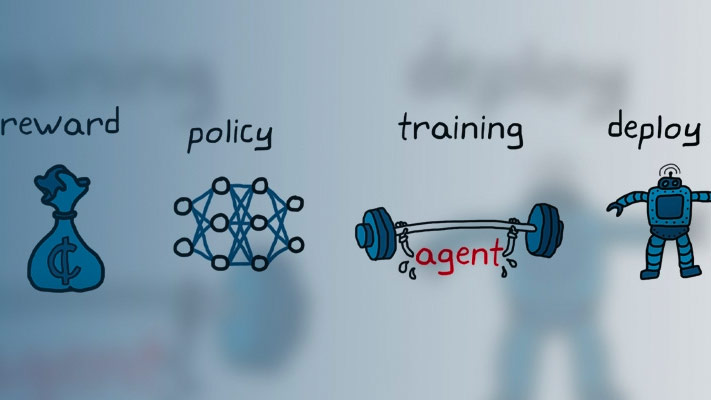

强化学习策略是一种映射,它根据对环境的观察选择要采取的行动。在训练期间,代理调整其政策代表的参数,以使长期回报最大化。

强化学习工具箱™软件为参与者和评论家的表示提供对象。行动者代表选择最佳行动的策略。评论家是估计当前政策价值的价值函数。根据您的应用程序和选择的代理,您可以使用深度神经网络、线性基函数或查找表定义策略函数和值函数。有关更多信息,请参见创建策略和值函数表示.