rlACAgent

行动者-批评家强化学习代理

描述

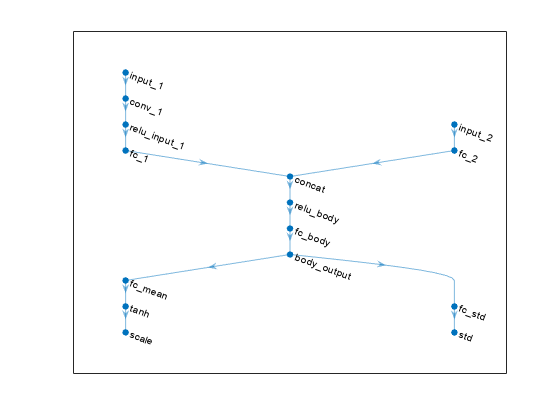

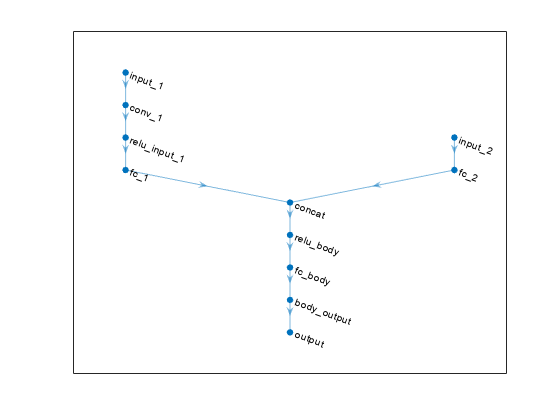

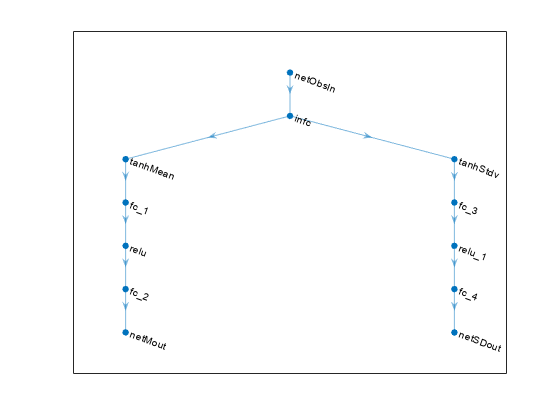

行为者-批评(AC)代理实现行为者-批评算法,如A2C和A3C,这是无模型的、在线的、基于政策的强化学习方法。行动者-评论家代理直接优化策略(行动者),并使用评论家来估计回报或未来的回报。动作空间可以是离散的,也可以是连续的。

有关更多信息,请参见Actor-Critic代理.有关不同类型的强化学习代理的更多信息,请参见强化学习代理.

创建

语法

描述

从观察和操作规范中创建代理

代理= rlACAgent (observationInfo,actionInfo)observationInfo以及动作规范actionInfo.

代理= rlACAgent (observationInfo,actionInfo,initOpts)initOpts对象。行动者-评论家代理不支持递归神经网络。金宝app有关初始化选项的更多信息,请参见rlAgentInitializationOptions.

指定代理选项

代理= rlACAgent (___,agentOptions)agentOptions输入参数。在前面语法中的任何输入参数之后使用此语法。

输入参数

属性

对象的功能

例子

提示

对于连续的动作空间,

rlACAgent对象不会强制操作规范设置的约束,因此必须在环境中强制操作空间约束。

另请参阅

rlAgentInitializationOptions|rlACAgentOptions|rlStochasticActorRepresentation|rlValueRepresentation|深层网络设计师