使用强化学习设计器创建代理

的强化学习设计师应用程序金宝app支持以下类型的代理。

深Q-Network代理(DQN)

深度确定性策略梯度代理(DDPG)

双延迟深层确定性策略梯度代理(TD3)

近端政策优化代理(PPO)

训练特工使用强化学习设计师,则必须首先创建或导入环境。有关更多信息,请参见为强化学习设计器创建MATLAB环境和为强化学习设计金宝app器创建Simulink环境.

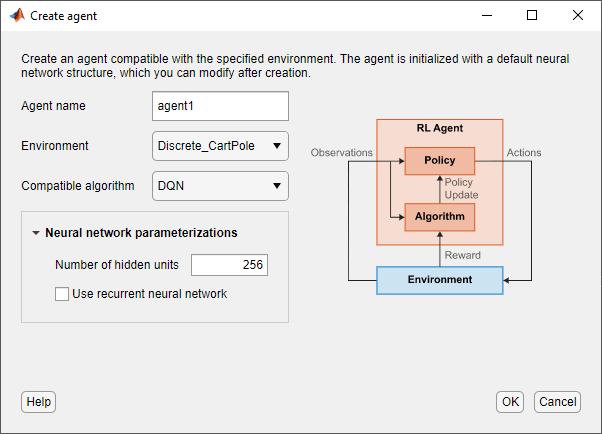

创建代理

要创建代理,请在强化学习选项卡,在代理人部分中,点击刚出现的.

在“创建代理”对话框中,指定以下信息。

代理名称-指定代理的名称。

环境—选择之前创建或导入的环境。

兼容的算法—选择agent训练算法。此列表只包含与所选环境兼容的算法。

的强化学习设计师应用程序使用默认的深度神经网络参与者和批评家表示创建代理。可以为默认网络指定以下选项。

隐藏单元数-指定演员和评论家网络的每个全连接或LSTM层的单元数。

使用递归神经网络-选择此选项,使用包含LSTM层的递归神经网络创建演员和评论家表示。

要创建代理,请单击好啊.

应用程序将新的默认代理添加到代理窗格,并打开用于编辑代理选项的文档。

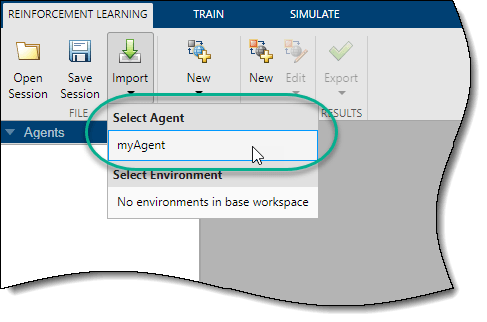

进口代理商

还可以从MATLAB中导入代理®工作区进入强化学习设计师。要这样做,请按强化学习选项卡上,单击进口. 然后,在选择代理,选择要导入的代理。

该应用程序将新的进口代理添加到代理窗格,并打开用于编辑代理选项的文档。

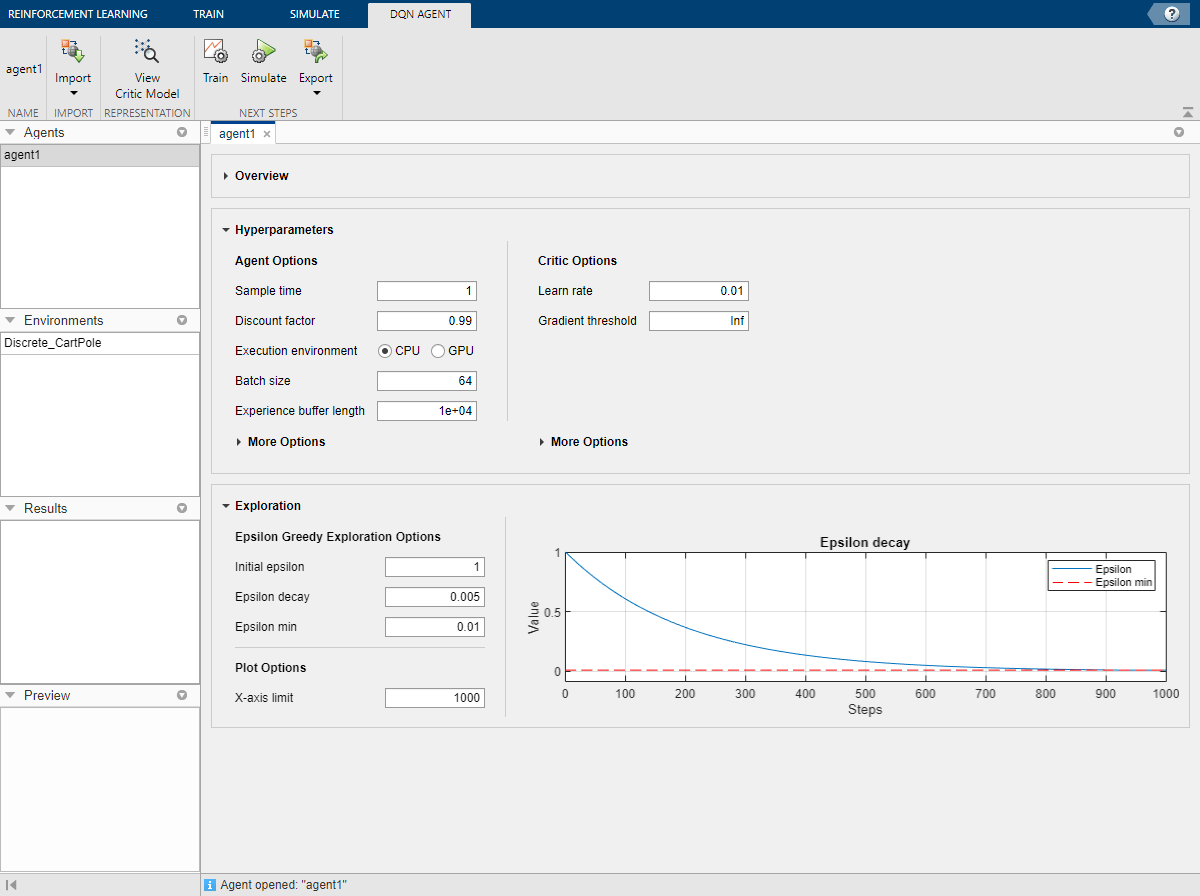

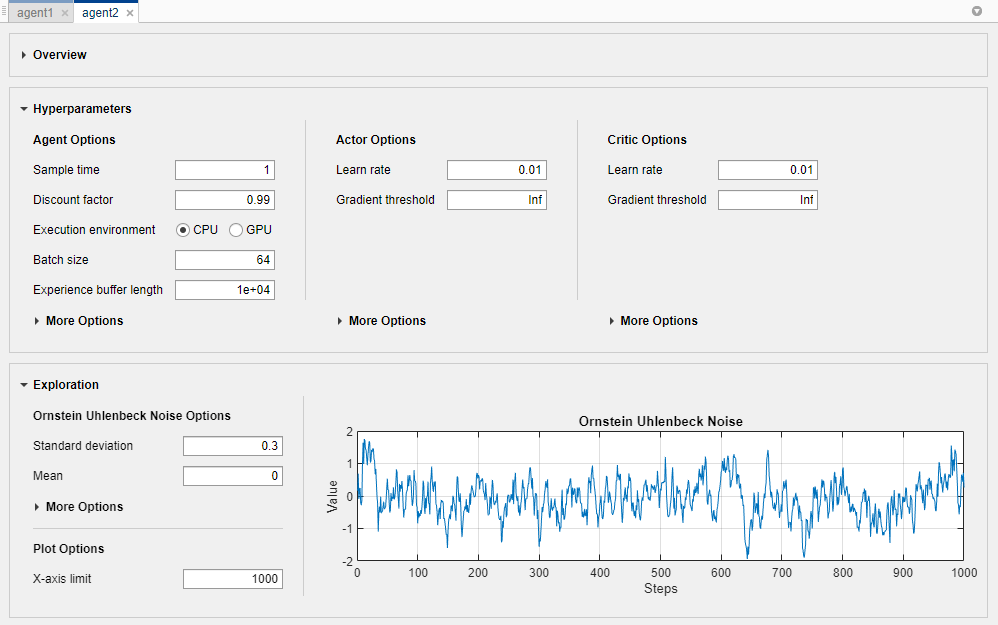

编辑代理选项

在里面强化学习设计师,可在相应的代理文档中编辑代理选项。

您可以为每个代理编辑以下选项。

代理选项-代理选项,例如采样时间和折扣系数。为所有支持的代理类型指定这些选项。金宝app

探索模型-探索模式选项。PPO代理没有探索模式。

目标策略平滑模型-目标政策平滑选项,仅支持TD3代理。金宝app

有关这些选项的更多信息,请参阅相应的代理选项对象。

rlDQNAgentOptions-DQN代理选项rlDDPGAgentOptions- DDPG代理选项rlTD3AgentOptions- TD3代理选项rlPPOAgentOptions- PPO代理选项

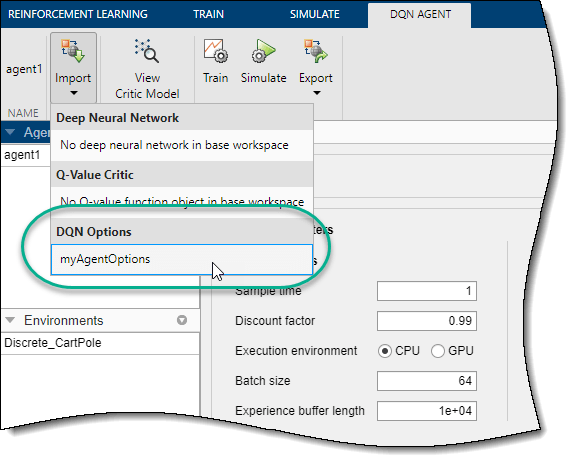

您可以从MATLAB工作区导入代理选项。要为每种类型的代理创建选项,请使用前面的对象之一。您还可以导入以前从强化学习设计师应用程序

来导入选项,在相应的代理人选项卡上,单击进口. 然后,在选项,选择一个选项对象。应用程序仅列出MATLAB工作区中兼容的选项对象。

应用程序将代理选项配置为与所选选项对象中的选项匹配。

演员兼评论家

您可以为每个代理编辑参与者和评论家表示的属性。

DQN代理人只有一个评论家网络。

DDPG和PPO代理有演员代表和评论家代表。

TD3代理有一个演员表示和两个评论家表示。当您修改TD3代理的评论家表示选项时,更改将应用于两个评论家。

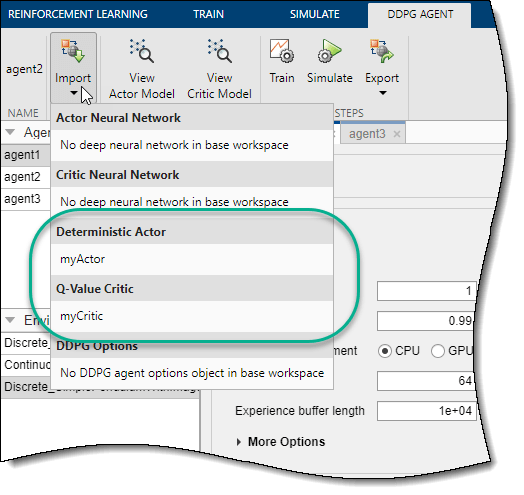

您还可以从MATLAB工作空间导入角色和评论表示。有关创建演员和影评人表示的更多信息,请参见创建策略和价值功能表示.您还可以导入您以前从强化学习设计师应用程序。

要导入演员或评论家表示,请在相应的代理人选项卡上,单击进口. 那么在这两种情况下,演员或评论家,选择具有与代理规范兼容的动作和观察规范的表示对象。

该应用程序将代理中的演员或影评人表示替换为选定的表示。如果您为一个TD3代理导入一个评论家表示,应用程序将为两个评论家替换网络。

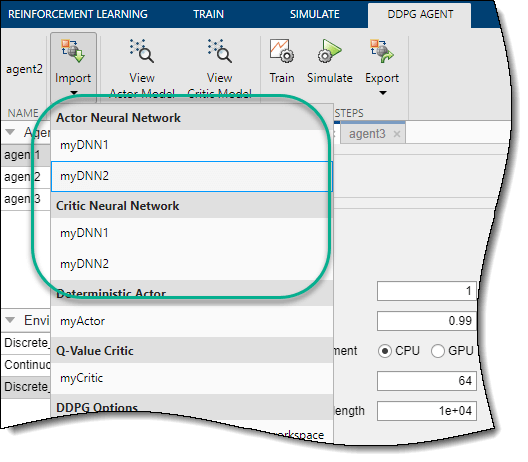

修正深度神经网络

要为参与者或评论家使用非默认的深度神经网络,必须从MATLAB工作空间中导入该网络。一种常用的策略是导出默认的深度神经网络,使用深度网络设计器应用程序,然后将其导入到强化学习设计师.有关为演员和评论家创建深度神经网络的更多信息,请参阅创建策略和价值功能表示.

导入一个深度神经网络,就相应的代理人选项卡上,单击进口. 那么在这两种情况下,演员神经网络或评论家神经网络,选择输入和输出层与代理的观察和动作规范兼容的网络。

该应用程序取代了相应的参与者或代理表示中的深度神经网络。如果你为一个TD3代理导入一个评论家网络,应用程序会为两个评论家替换网络。

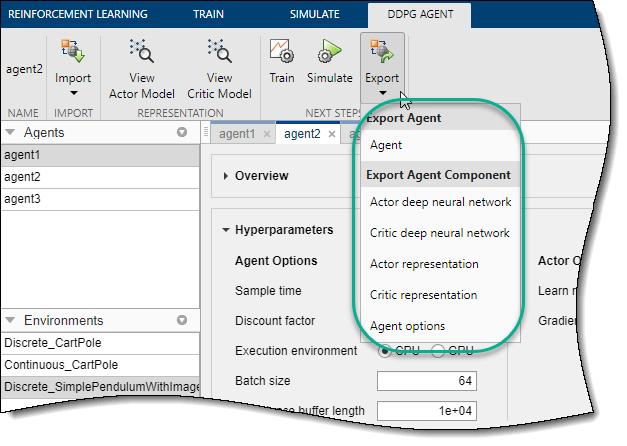

出口代理和代理组件

对于给定的代理,可以将以下任意内容导出到MATLAB工作区。

代理人

剂的选择

演员或评论家代表

演员或评论家深度神经网络

要导出代理或代理组件,请在相应的代理人选项卡上,单击出口.然后,选择要导出的项目。

应用程序在MATLAB工作空间中保存代理或代理组件的副本。