参考:Nello Cristianini和John 金宝appShawe-Taylor的支持向量机和基于内核的基于内核的学习方法的介绍]

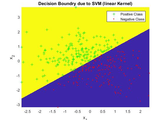

在这个演示中:训练或交叉验证支持向量机(SVM)模型,在低维数据集上进行两类(二进制)分类。金宝app

训练算法只依赖于H中的点积数据,即依赖于Φ(x_i)·Φ(x_j)形式的函数。下载188bet金宝搏如果有一个核函数K

K (x_i x_j) =Φ(x_i)·Φ(x_j),

我们只需要在培训算法中使用k,并且永远不需要明确地知道φ是什么。一个例子是径向基函数(RBF)或高斯内核,其中H是尺寸的,所以不会明确使用φ。

培训模式需要选择:

•决定决策曲面形状的核函数

•核函数中的参数(例如:高斯核:高斯的方差,多项式核:多项式的次数)

•正则化参数λ。

相关例子:

1.演算法

https://in.mathworks.com/matlabcentral/fileexchange/63156- adaboost.

2.使用各种内核的SVM

https://in.mathworks.com/matlabcentral/fileexchange/63033-svm-using-various-kernels

3.非线性分类的SVM

https://in.mathworks.com/matlabcentral/fileexchange/63024-svm-for-nonlinear-classification

4. SMO.

https://in.mathworks.com/matlabcentral/fileexchange/63100-smo-- sequential-minimal -optimization.-

引用作为

Bhartendu(2021)。金宝app支持向量机(//www.tatmou.com/matlabcentral/fileexchange/63158-金宝appsupport-vector-machine), MATLAB中央文件交换。检索.

什么是y_actual和y_preedette

@Matthys Holdout是一种CV(交叉验证)分区方法。

有人能告诉我抵抗函数的函数是什么吗?

亲爱的Bhartendu

您是否有描述您的工作的文档....您的投入受到高度赞赏

BR

谢谢@Yeonjong,这两个错误可能是由于MatLab版本不匹配造成的。

在运行这段代码时,我遇到了两个错误。

对我来说,以下的改变非常有效。

1.在grad-Ascend,

w1 = (alp_old * Y)。* X;= = > w1 = (alp_old。* Y) ' * X;

w2 =(α。* Y)。* X;= = > w2 =(α。* Y) ' * X;

2.策划

------------------------------------------------

信谊x

fn = vpa ((-bias-W (1) * x) / W (2), 4);

fplot (fn,“线宽”,2);

fn1 = vpa ((1-bias-W (1) * x) / W (2), 4);

fplot (fn1 '。');

FN2 = VPA(( - 1-偏压-W(1)* x)/ w(2),4);

fplot (fn2 '。');

------------------------------------------------

我改成了以下,它对我很有效。

------------------------------------------------

xItv = linspace (5 5 1000);

fn = @(x)vpa(( - bias-w(1)* x)/ w(2),4);

情节(xItv fn (xItv),“线宽”,2);

fn1 = @(x) vpa((1-bias-W(1)*x)/W(2),4);

情节(xItv fn1 (xItv) ', ');

fn2 = @(x) vpa((-1-bias-W(1)*x)/W(2),4);

情节(xItv fn2 (xItv) ', ');

是什么原因导致你对nhat truong评级较低?