使用Parcom来培训多个深度学习网络

这个例子展示了如何使用议案循环对训练选项执行参数扫描。

深度学习培训往往需要数小时或几天,并且寻求良好的培训选择可能很困难。通过并行计算,您可以加快并自动化搜索优良型号。如果您可以访问具有多个图形处理单元(GPU)的机器,则可以在使用本地Parpool的数据集的本地副本上完成此示例。如果您想使用更多资源,您可以扩展到云的深度学习培训。此示例显示如何在培训选项上使用Parcom循环执行参数扫描MiniBatchSize在云中的群集中。您可以修改脚本以在任何其他培训选项上执行参数扫描。此外,此示例显示了如何在计算期间从工人获取反馈达图.您还可以将脚本作为批处理作业发送到集群,这样您就可以继续工作或关闭MATLAB并在稍后获取结果。有关更多信息,请参见发送深度学习批作业到集群.

需求

在运行此示例之前,需要配置集群并将数据上传到云。在MATLAB中,您可以直接从MATLAB桌面在云中创建集群。在首页选项卡,平行菜单中,选择创建和管理集群.在集群配置文件管理器中,单击创建云集群.或者,您可以使用MathWorks Cloud Center来创建和访问计算集群。有关更多信息,请参见云中心入门.对于本例,请确保在MATLAB中将集群设置为默认值首页选项卡,在平行>选择默认群集.之后,将数据上传到Amazon S3桶,并直接从MATLAB使用它。本示例使用已经存储在Amazon S3中的CIFAR-10数据集的副本。说明,请参阅将深度学习数据上传到云端.

从云加载数据集

使用云加载培训和测试数据集imageDatastore.将培训数据拆分为培训和验证集,并保留测试数据设置以从参数扫描测试最佳网络。在此示例中,您可以使用存储在Amazon S3中的CIFAR-10数据集的副本。为了确保工人可以访问云中的数据存储,请确保正确设置AWS凭据的环境变量。看将深度学习数据上传到云端.

imds = imageageatastore('s3:// cifar10cloud / cifar10 /火车'那......“IncludeSubfolders”,真的,......“LabelSource”那'foldernames');imdsTest = imageDatastore (s3: / / cifar10cloud / cifar10 /测试”那......“IncludeSubfolders”,真的,......“LabelSource”那'foldernames');[imdsTrain, imdsValidation] = splitEachLabel (imd, 0.9);

用增强图像数据训练网络,通过创建一个augmentedImageDatastore对象。使用随机平移和水平反射。数据增强有助于防止网络过度拟合和记忆训练图像的确切细节。

imageSize = [32 32 3];PIXELRANGE = [-4 4];imageaugmenter = imagedataAugmenter(......“RandXReflection”,真的,......“RandXTranslation”,pixelrange,......“RandYTranslation”, pixelRange);imdsTrain augmentedImdsTrain = augmentedImageDatastore(图象尺寸,......'dataaugmentation'imageAugmenter,......“OutputSizeMode”那“randcrop”);

定义网络架构

为CIFAR-10数据集定义一个网络架构。为了简化代码,可以使用卷积块对输入进行卷积。池化层向下采样空间维度。

imageSize = [32 32 3];netDepth = 2;%NetDepth控制卷积块的深度NetWidth = 16;%NetWidth控制卷积块中的过滤器数量图层= [imageInputLayer(象限化)卷积块(NetWidth,NetDepth)MaxPooling2Dlayer(2,'走吧'2) convolutionalBlock (2 * netWidth netDepth) maxPooling2dLayer (2'走吧',2)卷积块(4 * NetWidth,NetDepth)普通Pooling2dlayer(8)全连接列(10)SoftmaxLayer分类层];

同时训练几个网络

指定要执行参数扫描的小批处理大小。为结果网络和准确性分配变量。

minibatchsize = [64 128 256 512];numMiniBatchSizes =元素个数(miniBatchSizes);trainedNetworks =细胞(numMiniBatchSizes, 1);精度= 0 (numMiniBatchSizes, 1);

执行一个并行参数扫描培训若干网络议案循环和改变小批量的大小。集群中的工作人员同时对网络进行训练,并在训练完成后将训练后的网络和准确性发送回来。如果您想检查训练是否有效,请设置详细的到真正的在培训选项中。注意,工人是独立计算的,因此命令行输出与迭代的顺序不同。

议案idx = 1: numminibatchsize minbatchsize = minbatchsize (idx);InitialLearnrate = 1E-1 * MINIBATCHSIZE / 256;%根据小批量大小缩放学习率。确定培训选项。设置迷你批次大小。选择= trainingOptions (“个”那......“MiniBatchSize”miniBatchSize,......%在扫描中设置相应的MiniBatchSize。“详细”假的,......%不发送命令行输出。“InitialLearnRate”,initiallearnrate,......%设置比例学习率。'L2Regularization'1平台以及......'maxepochs'30岁的......“洗牌”那“every-epoch”那......“ValidationData”,imdsvalidation,......“LearnRateSchedule”那'分段'那......“LearnRateDropFactor”,0.1,......'学习ropperiod',25);%在群集中的工作人员中培训网络。网= trainNetwork (augmentedImdsTrain层,选项);%要获得该网络的准确性,请使用培训的网络%对工作人员的验证图像进行分类,并将预测标签进行比较%实际标签。ypredictict =分类(net,imdsvalidation);精度(idx)= sum(ypredicted == imdsvalidation.labels)/ numel(imdsvalidation.labels);%将培训的网络发送回客户端。trainedNetworks {idx} =净;结束

使用myclusterincloud配置文件启动并行池(parpool)…连接到并行池(工作人员数量:4)。

后议案完成后,训练网络包含由工人培训的生成网络。显示培训的网络及其准确性。

训练网络

trainedNetworks =4×1个单元阵列{1×1 SeriesNetwork} {1×1 SeriesNetwork} {1×1 SeriesNetwork} {1×1 SeriesNetwork}

精度

精度=4×10.8188 0.8232 0.8162 0.8050

在准确性方面选择最好的网络。根据测试数据集测试其性能。

[~, I] = max(精度);bestNetwork = trainedNetworks{我(1)};YPredicted =分类(bestNetwork imdsTest);精度= sum(YPredicted == imdsTest.Labels)/numel(imdsTest.Labels)

精度= 0.8173

在培训期间发送反馈数据

准备和初始化显示每个工人培训进度的地块。采用动画线以方便地显示更改的数据。

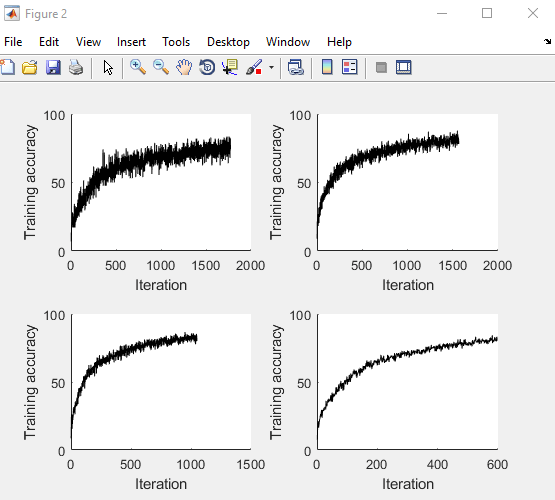

f =图;f.Visible = true;为i = 1:4次要情节(2,2,我)包含(“迭代”);ylabel('训练准确性');行(i)=动画线;结束

通过使用,将工人的培训进度数据发送给客户达图,然后绘制数据。每次工人发送培训进度反馈时,使用更新图afterEach.参数选择包含关于工作人员、培训迭代和培训准确性的信息。

d = parallel.pool.dataqueue;sulteAp(d,@(选择)updateplot(行,opts {:}));

执行一个并行参数扫描训练几个网络在一个parfor循环不同的小批量大小。注意OutputFcn在培训选项中,在每次迭代中将培训进度发送给客户。该图显示了执行以下代码期间四个不同工作人员的培训进度。

议案IDX = 1:NUMIB(MINIBATCHSIZE)MINIBATCHSIZE = MINIBATCHSIZE(IDX);InitialLearnrate = 1E-1 * MINIBATCHSIZE / 256;%根据miniBatchSize缩放学习率。确定培训选项。设置一个输出函数来发送回数据每个迭代到客户端的%。选择= trainingOptions (“个”那......“MiniBatchSize”miniBatchSize,......%在扫描中设置相应的MiniBatchSize。“详细”假的,......%不发送命令行输出。“InitialLearnRate”,initiallearnrate,......%设置比例学习率。'outputfcn',@(州)sendtrainingprogress(d,idx,state),......%设置输出函数,将中间结果发送到客户端。'L2Regularization'1平台以及......'maxepochs'30岁的......“洗牌”那“every-epoch”那......“ValidationData”,imdsvalidation,......“LearnRateSchedule”那'分段'那......“LearnRateDropFactor”,0.1,......'学习ropperiod',25);%在群集中的工作人员中培训网络。工人发送%向客户提供培训过程中的培训进度信息。网= trainNetwork (augmentedImdsTrain层,选项);%要获得该网络的准确性,请使用培训的网络%对工作人员的验证图像进行分类,并将预测标签进行比较%实际标签。ypredictict =分类(net,imdsvalidation);精度(idx)= sum(ypredicted == imdsvalidation.labels)/ numel(imdsvalidation.labels);%将培训的网络发送回客户端。trainedNetworks {idx} =净;结束

分析和将文件转移到工人......完成。

后议案完成后,训练网络包含由工人培训的生成网络。显示培训的网络及其准确性。

训练网络

trainedNetworks =4×1个单元阵列{1×1 SeriesNetwork} {1×1 SeriesNetwork} {1×1 SeriesNetwork} {1×1 SeriesNetwork}

精度

精度=4×10.8214 0.8172 0.8132 0.8112 0.8084

在准确性方面选择最好的网络。根据测试数据集测试其性能。

[~, I] = max(精度);bestNetwork = trainedNetworks{我(1)};YPredicted =分类(bestNetwork imdsTest);精度= sum(YPredicted == imdsTest.Labels)/numel(imdsTest.Labels)

精度= 0.8187

辅助函数

定义在网络架构中创建卷积块的函数。

函数图层=卷积块(NumFilters,NumConvlayers)图层= [卷积2dlayer(3,numfilters,“填充”那“相同”) batchNormalizationLayer reluLayer];层= repmat(层numConvLayers 1);结束

定义一个函数,以通过的方式向客户发送培训达图.

函数sendTrainingProgress (D, idx信息)如果信息。状态= =“迭代”发送(D, {idx、info.Iteration info.TrainingAccuracy});结束结束

定义更新功能以在工作者发送中间结果时更新绘图。

函数updateplot(行,idx,iter,acc)addpoints(行(idx),iter,acc);drawnlimitratenocallbacks结束

也可以看看

imageDatastore|trainNetwork|parallel.pool.dataqueue.(并行计算工具箱)

相关例子

更多关于

- 并行for循环(parfor)(并行计算工具箱)