主要内容

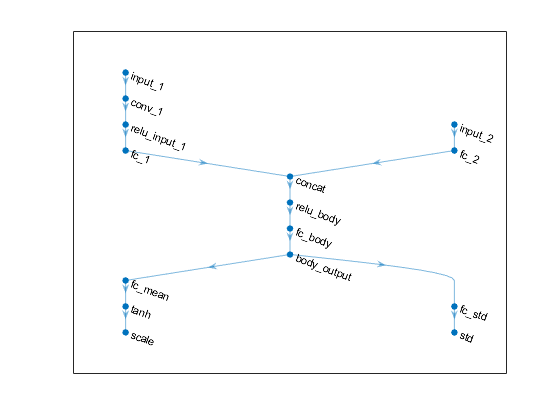

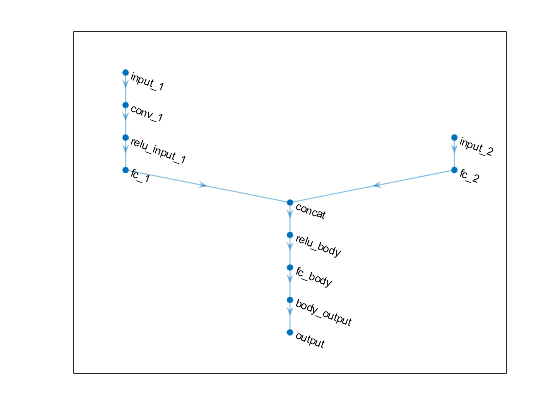

rlppoagent.

近端政策优化强化学习代理

描述

近端策略优化(PPO)是一种无模型,在线,政策,政策梯度加固学习方法。该算法通过环境相互作用的采样数据交替使用随机梯度下降来优化剪裁代理物镜。动作空间可以是离散或连续的。

创建

句法

描述

从观察和操作规范中创建代理

代理人= rlPPOAgent (观察税收那ActionInfo.)观察税收和行动规范ActionInfo..

代理人= rlPPOAgent (观察税收那ActionInfo.那初学者)初学者目的。演员批评者不支持经常性的神经网络。金宝app有关初始化选项的详细信息,请参阅rlagentinitializationOptions..

输入参数

特性

对象功能

火车 |

在指定环境中列车加固学习代理 |

SIM |

在指定环境中模拟培训的钢筋学习代理 |

努力 |

从代理商或演员代表获取行动给定环境观察 |

工作者 |

从强化学习代理中获得角色表示 |

setActor. |

设置钢筋学习代理的演员代表 |

getCritic |

获取钢筋学习代理人的批评奖学金 |

setcritic. |

设定批评批评学习代理的代表 |

生成policyfunction. |

创建评估强化学习代理的训练策略的函数 |

例子

提示

对于连续动作空间,此代理不会强制执行操作规范设置的约束。在这种情况下,您必须在环境中强制执行操作空间约束。

也可以看看

深层网络设计师|rlagentinitializationOptions.|rlppoagentoptions.|rlStochasticActorRepresentation|rlvalueerepresentation

在R2019B中介绍