rlstochastorrepresentation

加固学习代理的随机演员代表

描述

该目的实现了用作加强学习代理中的随机演员的功能近似器。随机演员将观察视为输入并返回随机动作,从而实现具有特定概率分布的随机策略。创建一个rlstochastorrepresentation对象,使用它来创建合适的代理,例如rlacagent.要么rlpgagent.代理人。有关创建表示的更多信息,请参阅创建策略和值函数表示.

创建

语法

描述

离散作用空间随机参与者

辩论推动机= rlstochastorReRepresentation(网,观察税收,discactionInfo.,'观察',obsname.)网作为函数的估计值。这里,的输出层网必须有尽可能多的元素可能的离散动作的数量。该语法设置观察税收和ActionInfo.属性辩论推动机对投入观察税收和discactionInfo.,分别。obsname.必须包含输入层的名称网.

辩论推动机= rlstochastorReRepresentation({基础FCN.,W0.},观察税收,ActionInfo.)基础FCN.到自定义基础函数,第二个元素包含初始权重矩阵W0..该语法设置观察税收和ActionInfo.属性辩论推动机对投入观察税收和ActionInfo.,分别。

辩论推动机= rlstochastorReRepresentation(___,选项)辩论推动机使用附加选项集选项,这是一个rlRepresentationOptions目的。该语法设置选项的属性辩论推动机到了选项输入参数。您可以使用任何以前的Infux-Argument组合使用此语法。

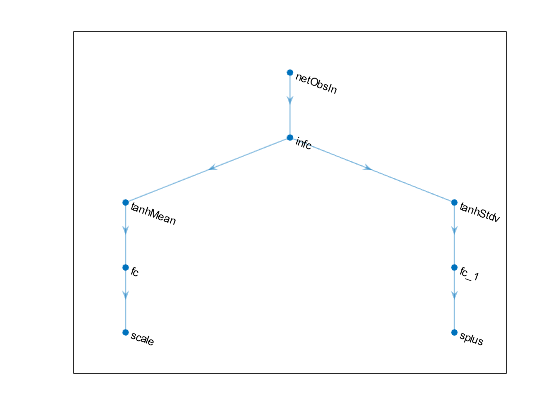

连续动作空间高斯演员

接触器= rlstochastorReRepresentation(网,观察税收,ContactionInfo.,'观察',obsname.)网作为函数的估计值。这里,的输出层网必须具有两倍的元素作为连续动作空间的尺寸的数量。该语法设置观察税收和ActionInfo.属性接触器对投入观察税收和ContactionInfo.分别。obsname.必须包含输入层的名称网.

请注意

接触器不强制执行操作规范设置的约束,因此,使用此Actor时,必须在环境中强制执行操作空间约束。

接触器= rlstochastorReRepresentation(___,选项)接触器使用额外的选项选项集,这是一个rlRepresentationOptions目的。该语法设置选项的属性接触器到了选项输入参数。您可以使用任何以前的Infux-Argument组合使用此语法。

输入参数

特性

对象的功能

rlacagent. |

行动者-批评家强化学习代理 |

rlpgagent. |

策略梯度强化学习代理 |

rlPPOAgent |

近端策略优化强化学习代理 |

rlSACAgent |

软演员 - 评论家强化学习代理 |

努力 |

根据环境观察,从行为者或行动者的表现中获得行动 |