layerGraph

深学习网络层的图

描述

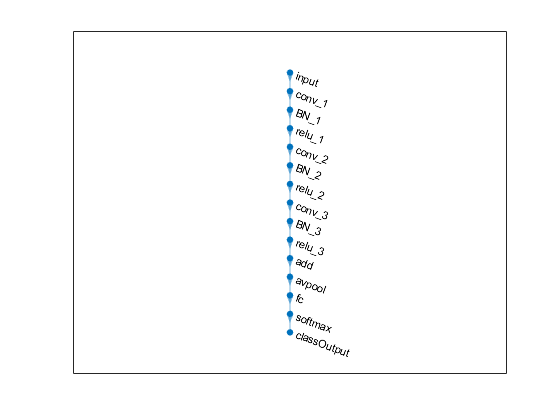

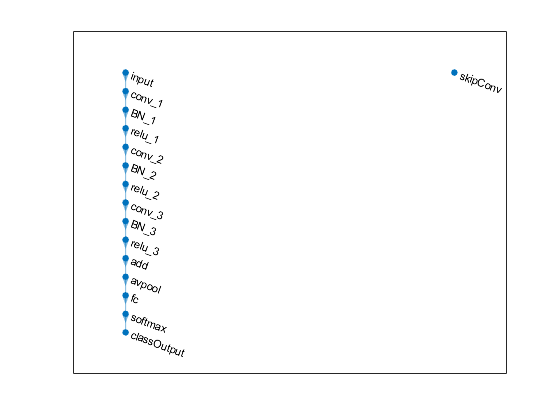

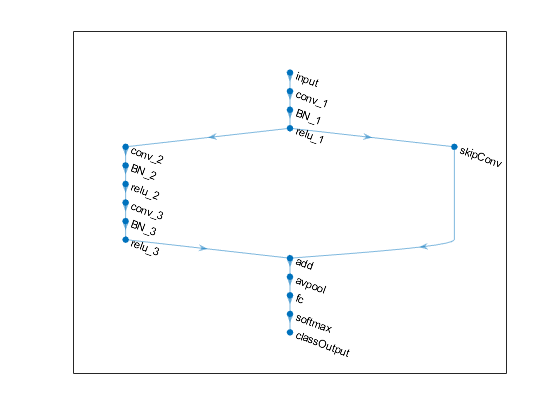

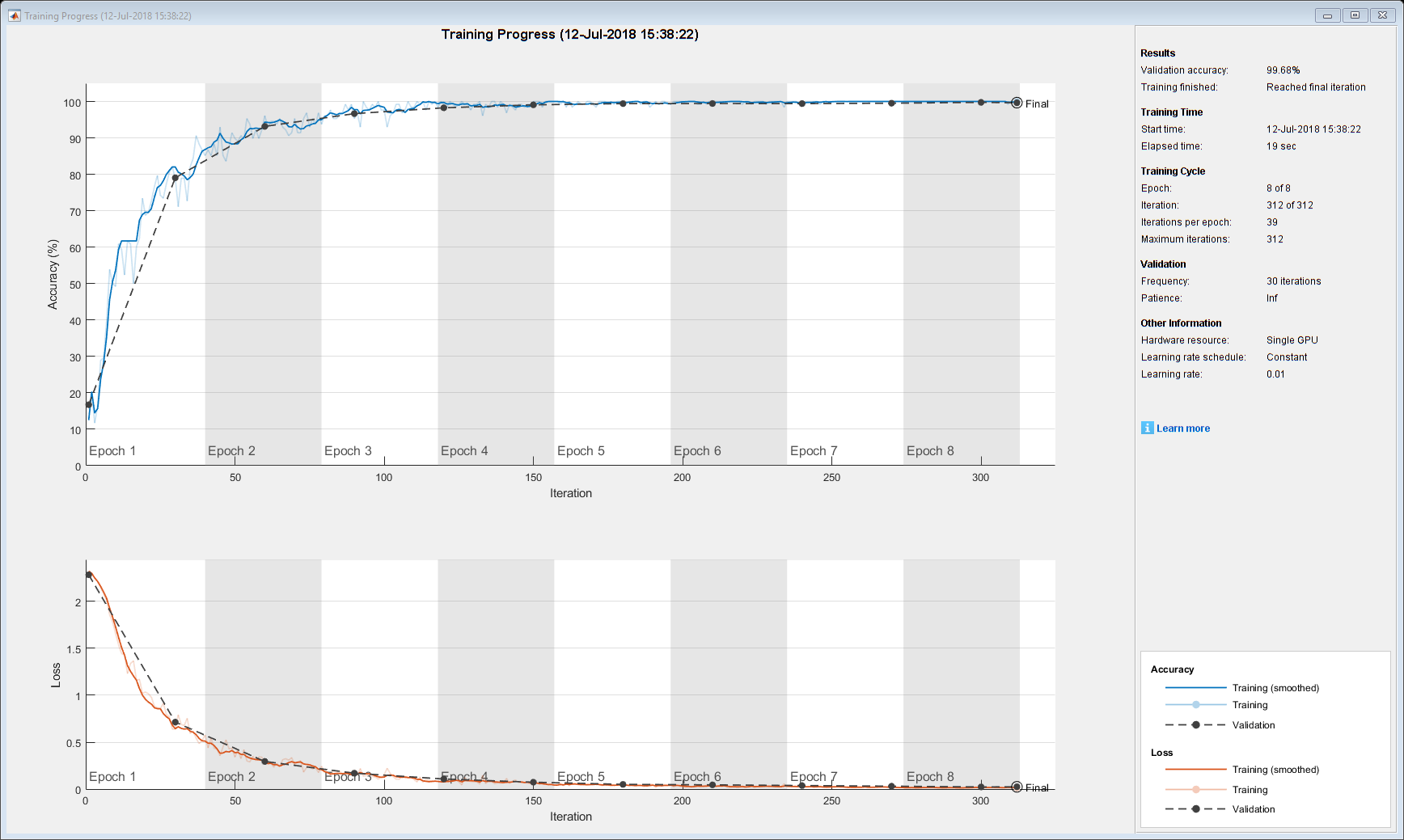

层图指定了深度学习网络的体系结构,它具有更复杂的图结构,其中层可以有来自多个层的输入和到多个层的输出。具有这种结构的网络称为有向无环图(DAG)网络。创建一个layerGraph对象,您可以使用对象函数来绘制图形,并通过添加、删除、连接和断开层来修改它。要训练网络,使用层图作为层输入参数trainNetwork.

创建

语法

描述

输入参数

属性

对象函数

addLayers |

向层图中添加层 |

removeLayers |

移除层图形层 |

replaceLayer |

在层图中替换层 |

connectLayers |

在层图中连接层 |

disconnectLayers |

在层图形断开层 |

情节 |

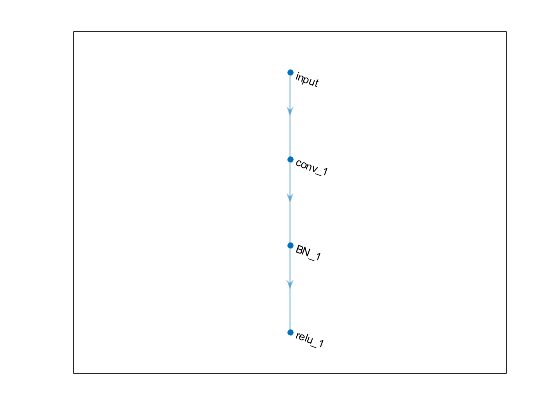

积神经网络层图形 |

例子

提示

层图不能指定长短时记忆(LSTM)网络的体系结构。有关如何创建LSTM网络的更多信息,请参见长短时记忆网络.

另请参阅

DAGNetwork|深层网络设计师|addLayers|additionLayer|analyzeNetwork|assembleNetwork|connectLayers|depthConcatenationLayer|disconnectLayers|googlenet|inceptionresnetv2|inceptionv3|情节|removeLayers|replaceLayer|resnet101|resnet18|resnet50|squeezenet|trainNetwork