主要内容

rlSACAgentOptions

SAC特工的选择

描述

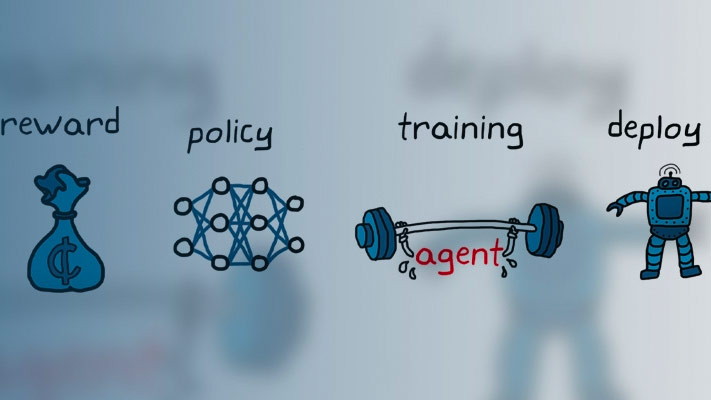

使用一个rlSACAgentOptions对象指定软演员评论(SAC)代理的选项。要创建SAC特工,请使用rlSACAgent.

有关更多信息,请参见软Actor-Critic代理.

有关不同类型的强化学习代理的更多信息,请参见强化学习代理.

创建

属性

对象的功能

rlSACAgent |

软演员-评论家强化学习代理 |

例子

参考文献

Richard S. Sutton和Andrew G. Barto。强化学习:简介.第二版。自适应计算和机器学习。麻省理工学院出版社,2018年。

介绍了R2020b