分类VM

金宝app支持向量机(SVM)用于一类和二值分类

描述

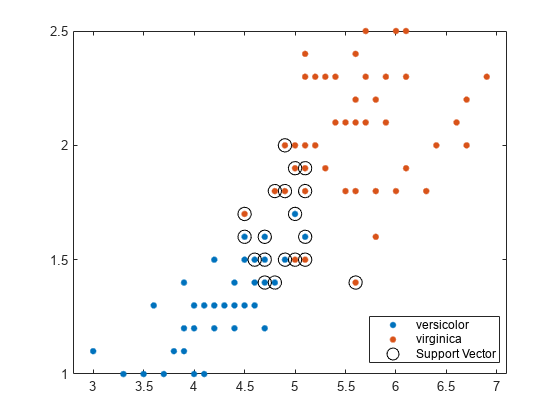

分类VM是一个金宝app支持向量机分类器用于一班和两班学习。经过培训分类VM分类器存储训练数据、参数值、先验概率、支持向量和算法实现信息。使用这些分类器执行任务,例如将分数拟合到后验概率变换函数(参见金宝appfitPosterior)和预测新数据的标签(见预测).

创造

创建一个分类VM通过使用fitcsvm.

属性

对象的功能

契约 |

减少机器学习模型的规模 |

CompareHoldout. |

使用新数据比较两个分类模型的准确性 |

横梁 |

交叉验证机器学习模型 |

discard金宝appSupportVectors |

丢弃线性支持向量金宝app机分类器的支持向量 |

边缘 |

为支持向量机分类器寻找分类边缘金宝app |

fitPosterior |

支持向量机(SVM)分类器的拟合后验概率金宝app |

incrementalLearner |

将二进制分类支持向量机(SVM)模型转换为增量学习者金宝app |

损失 |

寻找支持向量机(SVM)分类器的分类误差金宝app |

保证金 |

为支持向量机分类器寻找分类边缘金宝app |

部分竞争 |

计算部分依赖 |

局部依赖 |

创建部分依赖图(PDP)和个人条件期望图(ICE) |

预测 |

使用支持向量机(SVM)分类器分类观察金宝app |

重新提交 |

Resubstitution分类边缘 |

石灰 |

局部可解释的模型不可知解释(LIME) |

resubloss. |

Resubstitution分类损失 |

resubMargin |

重新取款分类保证金 |

重新预订 |

使用训练的分类器对训练数据进行分类 |

恢复 |

恢复培训支持向量机(SVM)分类金宝app器 |

福芙 |

沙普利值 |

testckfold |

通过重复交叉验证比较两种分类模型的准确性 |

例子

更多关于

算法

支持向量机二值分类算法的数学公式见金宝app二值分类的支持向量机和理解支持向量机金宝app.

南那<定义>,空字符向量(''),空字符串(""), 和< >失踪值表示缺失的值。fitcsvm删除与缺失响应对应的整行数据。在计算总权重时(见下一条),fitcsvm忽略与至少缺少一个预测器的观测值相对应的任何权重。此操作可能导致平衡类问题中的先验概率不平衡。因此,观测框约束可能不相等BoxConstraint.fitcsvm删除权重为零或先验概率为零的观察值。对于两类学习,如果你指定代价矩阵 (见

费用),然后软件更新类的先验概率P.(见之前)P.C通过纳入本节中所述的处罚 .具体地说,

fitcsvm完成这些步骤:计算

规范化P.C*更新后的先验概率和是1。

K.是班级的数量。

将代价矩阵重置为默认值

从对应于具有零先验概率的类的训练数据中移除观察值。

对于两班学习,

fitcsvm将所有观测权归一化(见重量)求和为1。然后,该函数对归一化权重进行重归一化,使其总和为观测所属类的更新先验概率。即观察的总权重j在班上K.是W.j是标准化的观测权值吗j;P.C那K.更新的类先验概率是多少K.(见以前的子弹)。

对于两班学习,

fitcsvm为培训数据中的每个观察分配一个框约束。用于观察的盒子约束的公式j是N为训练样本量,C0.初始框约束(参见

“BoxConstraint”名称-值对参数),以及 是观察的总重量j(见以前的子弹)。如果你设置

“标准化”,没错和“成本”那“之前”,或“重量”名称值对参数,然后fitcsvm使用相应的加权平均值和加权标准差对预测值进行标准化。就是,fitcsvm标准化预测j(Xj)使用Xjk是观察K.(行)的预测j(列)。

假设

P.是你在训练数据中期望的和你设置的异常值的比例吗OutlierFraction, p.对于一节课的学习,软件训练偏差项,使其达到100

P.%在训练数据中的观察值中,有1%的得分为负值。该软件实现了强劲的学习两级学习。换句话说,该软件试图删除100个

P.%优化算法收敛时的观测值。移除的观测值对应于幅度较大的梯度。

如果预测器数据包含分类变量,则软件通常对这些变量使用完全虚拟编码。软件为每个分类变量的每个级别创建一个虚拟变量。

这

PredictorNames属性为每个原始预测器变量名存储一个元素。例如,假设有三个预测因子,其中一个是具有三个层次的分类变量。然后PredictorNames是包含预测变量原始名称的字符向量的1×3单元格数组。这

ExpandedPredictorNames属性存储每个预测变量的一个元素,包括虚拟变量。例如,假设有三个预测因子,其中一个是具有三个层次的分类变量。然后ExpandedPredictorNames是包含预测变量的名称和新的虚拟变量的一个字符向量的一个1-5个单元格阵列。同样,

β属性为每个预测器存储一个beta系数,包括虚拟变量。这

金宝appSupportVectors属性存储支持向量的预测值,包括虚拟变量。例如,假设有金宝appm金宝app支持向量和三个预测因子,其中一个是有三个层次的分类变量。然后金宝appSupportVectors是一个N-by-5矩阵。这

X属性将训练数据存储为原始输入,不包括虚拟变量。当输入是一个表时,X仅包含用作预测器的列。

对于表中指定的预测器,如果任何变量包含有序(有序)类别,软件将对这些变量使用有序编码。

对于一个变量K.订购级别,软件创建K.– 1虚拟变量j第一个哑变量为–1对于以下级别j,+1适合水平j+ 1通过K..

存储在中的虚拟变量的名称

ExpandedPredictorNames属性指示具有该值的第一级+1.软件商店K.– 1虚拟变量的附加预测器名称,包括级别2、3、…K..

所有解算器都执行L.1 soft-margin最小化。

对于单类学习,软件估计拉格朗日乘数,α1,...,αN,这样

参考文献

Hastie, T., R. Tibshirani, J. Friedman。统计学习的要素,第二版。纽约:施普林格,2008年。

Scholkopf, B., J. C. Platt, J. C. shaw - taylor, A. J. Smola, R. C. Williamson。"估算高维分布的支持度"金宝app神经计算机。,卷。13,第7号,2001号,第1443-1471页。

克里斯汀尼尼,N。c。肖-泰勒。支持向量机和其他基于核的学习方法简介金宝app英国剑桥:剑桥大学出版社,2000年。

[4] Scholkopf, B.和A. Smola。核学习:支持向量机,正则化,优化和超越,自适应金宝app计算和机器学习。麻省剑桥:麻省理工学院出版社,2002年。