利用深度学习复杂物理过程

客人的博客:Peetak Mitra,Majid Haghshenas博士和David P. Schmidt教授

以下是在神经信息处理系统(NEURIPS)机器学习的接受文件,用于工程设计,模拟研讨会2020.这项工作是ICENET联盟的一部分,是建立与建模相关的数据驱动工具的行业资助的努力燃烧发动机。可以在iCenetCfd.com找到更多详细信息

近年来,人们对使用机器学习建模物理应用的兴趣激增。施密特教授在马萨诸塞大学阿默斯特分校的研究小组一直致力于将这些方法应用于湍流闭合、粗粒化、燃烧或为复杂物理过程建造廉价的仿真器。在本博客中,我们将介绍将主流机器学习算法应用于特定领域的当前挑战,并展示我们如何在我们感兴趣的科学应用中应对这一挑战,即与流体湍流相关的闭合建模。

当前的挑战

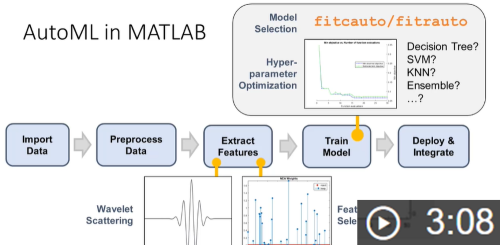

在设计网络和选择超参数方面的ML算法和最佳实践,已被开发用于计算机视觉、自然语言处理等应用。这些数据集的损失流形本质上与在科学数据集中观察到的损失流形有很大的不同[参见图1,以两个变量的函数产生的损失为例,通过翻译和缩放高斯分布获得,高斯分布是科学和工程中的一种常见分布]。因此,通常这些来自文献的最佳实践在科学领域的应用中翻译得很差。这样做的一些主要挑战包括用于开发机器学习算法的数据以基本方式与科学数据不同;由于科学数据通常是高维,多式联运,复杂,结构和/或稀疏[1]。目前SCIML的创新步伐还由这些规范ML / DL技术的经验探索/实验驱动和限制。为了充分利用数据的复杂性以及开发优化的ML模型,自动机器学习(Automl)用于自动化网络设计和选择最佳性能的超参数的方法是批判性的。在这项工作中,我们探讨了贝叶斯基础的自动化方法对复杂物理仿真器的效力,努力构建强大的神经网络模型。

结果

结果表明,虽然ADAM Glorot配置的参数数最高,但ADAM和ADAM He组合的绝对误差最高。RMPSProp的平均性能优于SGDM优化器。这可以解释为RMSProp是一种自适应学习率方法,能够在局部最优区域导航,而SGDM在峡谷导航中表现较差,并在向局部最优方向前进时犹豫不决。最佳性能模型的先验性能如图4所示。

图5所示。利用网络训练检查点的余弦相似度,可以直观地看出学习过程的演化过程。

图5所示。利用网络训练检查点的余弦相似度,可以直观地看出学习过程的演化过程。

|

|

图6。重量初始化和优化器的功能空间相似性的低维表示显示了重要的外卖。

总之,它提供了一种途径,不仅可以建立适用于科学数据集应用的鲁棒神经网络,还可以用来更好地理解网络训练演化过程。 要了解更多关于我们的工作,请遵循预印本在这里,并观看Neurips 2020 ML4UNG Workshop Spotlight Talk在这里。参考文献

[1]: Dias Ribeiro, Mateus, Alex Mendonça Bimbato, Maurício Araújo Zanardi, José Antônio Perrella Balestieri, David P. Schmidt。“使用开源框架对直喷式火花点火发动机中的流动进行大涡模拟。”国际发动机研究(2020):1468087420903622

|

- 类别:

- 深度学习

克利夫角:克利夫·莫尔谈数学和计算机

克利夫角:克利夫·莫尔谈数学和计算机 Loren在Matlab的艺术上

Loren在Matlab的艺术上 史蒂夫在图像处理与matlab

史蒂夫在图像处理与matlab 人在仿真软件金宝app

人在仿真软件金宝app 深度学习

深度学习 开发区域

开发区域 斯图尔特的MATLAB视频

斯图尔特的MATLAB视频 在标题后面

在标题后面 本周的文件交换选择

本周的文件交换选择 汉斯在物联网

汉斯在物联网 赛车休息室

赛车休息室 初创企业、加速器和企业家

初创企业、加速器和企业家 MATLAB社区

MATLAB社区 MATLABユーザーコミュニティー

MATLABユーザーコミュニティー

评论

要留下评论,请点击在这里登录到您的MathWorks帐户或创建一个新帐户。