基于深度学习的三维脑肿瘤分割

该示例显示如何训练3-D U-Net神经网络,并从三维医学图像执行脑肿瘤的语义分割。

语义分割包括用类标记图像中的每个像素或三维体素。这个例子说明了如何使用深度学习方法在磁共振成像(MRI)扫描中对脑肿瘤进行二元语义分割。在这种二值分割中,每个像素都被标记为肿瘤或背景。

该示例使用3-D U-Net架构进行脑肿瘤分割[1].U-Net是一种快速,高效,简单的网络,它在语义分段域中流行。

医学图像分割的一个挑战是存储和处理3d体积所需的内存量。由于GPU资源的限制,在全输入量上训练网络是不切实际的。这个例子通过在图像补丁上训练网络来解决这个问题。该示例使用重叠策略将测试补丁缝合到一个完整的分段测试卷中。该示例通过使用神经网络中卷积的有效部分来避免边界伪影[5.].

医学图像分割的第二个挑战是,当使用传统的交叉熵损失时,数据中的类别不平衡妨碍了训练。这个例子通过使用加权多类骰子损失函数解决了这个问题[4.].加权课程有助于对较大区域对骰子分数的影响,使网络更容易学习如何分割更小的区域。

下载培训,验证和测试数据

此示例使用BRATS数据集[2].Brats数据集包含脑肿瘤的MRI扫描,即胶质瘤,这是最常见的主要脑恶性肿瘤。数据文件的大小为约7 GB。如果您不想下载BRATS数据集,则直接转到下载佩带的网络和样本测试集节。

创建一个目录来存储BraTS数据集。

imagedir = fullfile(tempdir,“小子们”);如果〜存在(Imageager,“dir”mkdir (imageDir);结尾

要下载Brats数据,请转到医疗细分迪卡侬网站并单击“下载数据”链接。下载“task01_braintumour.tar”文件[3.].将tar文件解压缩到由此指定的目录中imageDir变量。当成功解压缩,imageDir将包含一个名为Task01_脑瘤它有三个子目录:imagesTr那imagesTs, 和labelsTr.

该数据集包含750个4-D卷,每个卷代表一堆3-D图像。每个4-D卷的尺寸为240 × 240 × 155 × 4,其中前三个维度对应于一个3-D体积图像的高度、宽度和深度。第四维对应不同的扫描方式。该数据集被分为484个带有体素标签的训练卷和266个测试卷,测试卷没有标签,所以本例没有使用测试数据。相反,该示例将484个训练卷分成三个独立的集,用于训练、验证和测试。

预处理培训和验证数据

要更有效地培训3-D U-Net网络,请使用辅助功能预处理MRI数据preprocessBraTSdataset.这个函数作为支持文件附加到示例中。金宝app

helper函数执行以下操作:

将数据裁剪到主要是大脑和肿瘤的区域。裁剪数据减少了数据的大小,同时保留每个MRI卷的最关键部分及其相应的标签。

将每个体积的每个模态单独归一化,方法是减去平均值并除以剪裁后的大脑区域的标准偏差。

将484次训练卷分成400次培训,29份验证和55个测试集。

数据预处理大约需要30分钟。

sourcedataloc = [imageageR filesep“Task01_BrainTumour”];preprocessdataloc = fullfile(tempdir,“小子们”那“preprocessedDataset”);Preprocessbratsdataset(PreprocessDataloc,SourceDataloc);

为培训和验证创建随机补丁提取数据存储

使用随机补丁提取数据存储将训练数据提供给网络,并验证训练进度。该数据存储从地面真实图像和相应的像素标签数据中提取随机补丁。补丁是一种常见的技术,用于在使用任意大容量训练时防止内存耗尽。

创建一个imageDatastore存储三维图像数据。由于MAT文件格式是非标准图像格式,因此必须使用MAT文件读取器才能读取图像数据。可以使用帮助器MAT文件读取器,基质.这个函数作为支持文件附加到示例中。金宝app

volReader = @(x) matRead(x);volloc = fullfile(preprocessdataloc,'想象的');volds = imagedataStore(volloc,...“FileExtensions”那'。垫'那'readfcn', volReader);

创建一个pixelLabelDatastore(电脑视觉工具箱)存储标签。

lblLoc=fullfile(预处理数据LOC,“labelsTr”);ClassNames = [“背景”那“瘤”];Pixellabelid = [0 1];pxds = pixellabeldataStore(LBLLOC,ClassNames,Pixellabelid,...“FileExtensions”那'。垫'那'readfcn', volReader);

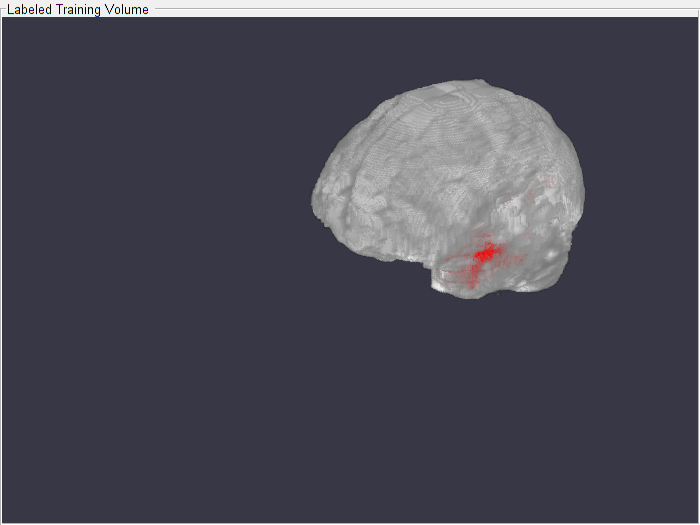

预览一个图像卷和标签。使用该标记的卷labelvolshow函数。通过设置背景标签的可见性来使后台完全透明(1)0..

卷=预览(volds);标签=预览(PXD);ViewPnl = Uipanel(图,“标题”那“标记训练卷”);hpred = labelvolshow(标签,卷(:,:::,1),'父母',viewPnl,...'lablecolor',[0 0 0; 1 0 0]);hpred.Labelvisibility(1)= 0;

创建一个随机抽取数据存储包含训练图像和像素标签数据的。指定132×132×132体素的面片大小。指定“PatchesPerImage”在训练过程中,从每对卷和标签中抽取16个随机定位的patch。指定迷你批处理大小为8。

patchsize = [132 132 132];patchperimage = 16;minibatchsize = 8;patchds = RandOMPatchExtractionDataStore(VOLDS,PXD,PatchSize,...“PatchesPerImage”,patchperimage);patchds.minibatchsize = minibatchsize;

按照相同的步骤创建一个随机抽取数据存储它包含验证图像和像素标签数据。随着时间的推移,您可以使用验证数据来评估网络是否在持续学习、欠拟合或过拟合。

vollocval = fullfile(preprocessdataloc,“imagesVal”);voldsVal=图像数据存储(volLocVal,...“FileExtensions”那'。垫'那'readfcn', volReader);lblLocVal = fullfile (preprocessDataLoc,'labelsval');pxdsval = pixellabeldataStore(lbllocval,classnames,pixellabelid,...“FileExtensions”那'。垫'那'readfcn', volReader);dsVal = randomPatchExtractionDatastore (voldsVal pxdsVal patchSize,...“PatchesPerImage”,patchperimage);dsval.minibatchsize =小匹匹匹匹配;

通过使用使用的培训和验证数据来增加培训和验证数据变换函数具有helper函数指定的自定义预处理操作增强和Crop3dPatch.这个函数作为支持文件附加到示例中。金宝app

这增强和Crop3dPatchFunction执行以下操作:

随机旋转并反映培训数据,使培训更加强大。该功能不旋转或反映验证数据。

裁剪响应面片到网络的输出大小,44×44×44体素。

datasource =“培训”;dstrain =变换(patchds,@(patchin)augmentandcrop3dpatch(patchin,dataSource));datasource =“验证”;dsVal =变换(dsVal @ (patchIn) augmentAndCrop3dPatch (patchIn数据源));

设置3-D U-Net层

此示例使用3-D U-Net网络[1].在U-NET中,初始卷积层系列耦合到MAX池层,连续降低输入图像的分辨率。这些层之后是一系列卷积层,其遍历上采样操作员,连续增加输入图像的分辨率。在每个Relu层之前引入批量归一化层。U-Net的名称来自于网络可以用与字母U类似的对称形状绘制。

通过使用使用默认的3-D U-Net网络unetLayers(电脑视觉工具箱)函数。指定两个类分割。当使用重叠策略预测测试量时,还指定有效的卷积填充以避免边界伪影。

inputPatchSize=[132 4];NumClass=2;[lgraph,outPatchSize]=unet3dLayers(inputPatchSize,NumClass,“ConvolutionPadding”那“有效”);

为了更好地分割较小的肿瘤区域并减少较大背景区域的影响,本例使用adicepixelclassificationlayer.(电脑视觉工具箱).将像素分类层替换为骰子像素分类层。

outputLayer=dicePixelClassificationLayer('姓名'那'输出');lgraph=替换层(lgraph,'分段层', outputLayer);

数据已经在预处理培训和验证数据本例的第节。中的数据规范化image3dinputlayer.(深度学习工具箱)不必要,因此用没有数据归一化的输入层替换输入层。

inputLayer=image3dInputLayer(inputPatchSize,“正常化”那'没有任何'那'姓名'那'imageinputlayer');lgraph=替换层(lgraph,'imageinputlayer', inputLayer);

或者,您可以使用深度学习工具箱™中的深度网络设计器应用程序修改3-D U-Net网络。

绘制更新后的三维U-Net网络图。

analyzeNetwork (lgraph)

指定培训选项

训练网络使用亚当优化解算器。使用trainingOptions(深度学习工具箱)函数。初始学习率设置为5e-4,并随着训练的持续而逐渐降低。你可以用小匹匹匹匹配属性。若要最大限度地提高GPU内存利用率,请选择较大的输入修补程序而不是较大的批处理大小。请注意,对于较小的小匹匹匹匹配.调整初始学习率基于小匹匹匹匹配.

选项=培训选项(“亚当”那...“MaxEpochs”,50,...'italllearnrate'5的军医,...“LearnRateSchedule”那“分段”那...“LearnRateDropPeriod”5,...'学习ropfactor',0.95,...'vightationdata',dsval,...“ValidationFrequency”,400,...'plots'那“训练进步”那...“冗长”假的,...“MiniBatchSize”,小匹匹匹匹配);

下载佩带的网络和样本测试集

从BraTS数据集下载预先训练过的3d U-Net版本和五份样本测试卷及其相应的标签[3.].预先训练的模型和样本数据使您能够对测试数据进行分割,而无需下载完整的数据集或等待网络训练。

训练3dunet_url =.'//www.tatmou.com/金宝appsupportfiles/vision/data/brainTumor3DUNetValid.mat';sampleData_url='//www.tatmou.com/金宝appsupportfiles/vision/data/sampleBraTSTestSetValid.tar.gz';imagedir = fullfile(tempdir,“小子们”);如果〜存在(Imageager,“dir”mkdir (imageDir);结尾下载3dunetsampledata(trouth3dunet_url,sampledata_url,imagedir);

火车网络

默认情况下,本例加载一个预先训练好的三维U-Net网络。预先训练过的网络使您无需等待训练完成就可以运行整个示例。

要训练网络,请设置用圆形以下代码中的变量真正的.使用Trainnetwork.(深度学习工具箱)函数。

如果GPU可用,在GPU上训练。使用GPU需要并行计算工具箱™ 以及支持CUDA®的NVIDIA®GPU。有关更多信息,请参阅GPU版金宝app本支持(并行计算工具箱).在配备4个NVIDIA的多GPU系统上进行培训大约需要30小时™ Titan Xp GPU,可能需要更长的时间,具体取决于您的GPU硬件。

doTraining = false;如果dotrained modeldateTem = string(DateTime(“现在”那“格式”那“yyyy MM dd HH MM ss”));[NET,INFO] = Trainnetwork(Dstrain,Largrain,选项);保存(strcat(“训练3dunet-”modelDateTime,“时代——”,num2str(options.maxepochs),“.mat”),'网');别的InputPatchSize = [132 132 132 4];outpatchsize = [44 44 44 2];加载(FullFile(Imagedir,'训练3dunet'那'braintumor3dunetvalid.mat'));结尾

对测试数据进行分割

强烈建议使用GPU来执行图像卷的语义分割(需要并行计算工具箱™)。

选择测试数据的源,其中包含接地真理卷和标签进行测试。如果你保留useFullTestSet变量为错误的,则示例使用五个卷进行测试useFullTestSet变量到真正的,然后示例使用从完整数据集中选择的55个测试图像。

useFullTestSet = false;如果useFullTestSet-volLocTest=fullfile(预处理数据位置,“变化节”);lblLocTest = fullfile (preprocessDataLoc,“labelsTest”);别的volloctest = fullfile(imagedir,'samplebratstestsetvalid'那“变化节”);lblLocTest=fullfile(imageDir,'samplebratstestsetvalid'那“labelsTest”);ClassNames = [“背景”那“瘤”];Pixellabelid = [0 1];结尾

这voldstest.变量存储地面真理测试图像。这pxdsTestVariable存储ground真值标签。

volReader = @(x) matRead(x);voldsTest = imageDatastore (volLocTest,...“FileExtensions”那'。垫'那'readfcn', volReader);pixelLabelID pxdsTest = pixelLabelDatastore (lblLocTest,一会,...“FileExtensions”那'。垫'那'readfcn', volReader);

使用重叠平铺策略预测每个测试卷的标签。每个测试卷被填充,使输入大小为网络输出大小的倍数,并补偿有效卷积的影响。重叠平铺算法选择重叠补丁,通过使用SemanticSeg.(电脑视觉工具箱)函数,然后重新组合修补程序。

id = 1;尽管hasdata (voldsTest) disp ([“处理测试量”num2str(ID)]);tempgroundtruth =读(pxdstest);TroundTruthlabels {id} = tempgroundtruth {1};Vol {id} =读取(VoldStest);%对测试图像使用反射填充。%避免填充不同的模式。volsize = size(vol {id},(1:3));Padsizepre =(InputPatchsize(1:3)--outpatchsize(1:3))/ 2;padsizepost =(InputPatchsize(1:3)--outpatchsize(1:3))/ 2 +(分开(1:3)-mod(剧集,分类(1:3));volpaddedpre = padarray(vol {id},padsizepre,“对称”那'pre');volPadded=padarray(volPaddedPre,padSizePost,“对称”那“职位”); [heightPad,widthPad,depthPad,~]=尺寸(填充);[高度、宽度、深度,~]=大小(vol{id});tempSeg=分类(零([高度、宽度、深度],“uint8”),[0; 1],ClassNames);%重叠的策略分割的体积。为了k = 1: outPatchSize (3): depthPad-inputPatchSize (3) + 1为了j=1:outPatchSize(2):widthPad inputPatchSize(2)+1为了i = 1:outPatchSize(1):heightPad-inputPatchSize(1)+1 patch = volpads (i:i+inputPatchSize(1)-1,...J:J + InputPatchSize(2)-1,...凯西:k + inputPatchSize (3) 1:);patchSeg = semanticseg(补丁,净);tempSeg(我+ outPatchSize (1) 1...j:j+outPatchSize(2)-1,...k:k+outPatchSize(3)-1)=patchSeg;结尾结尾结尾裁掉额外的填充区域。tempSeg = tempSeg(1:身高、1:宽度、1:深度);%保存预测的卷结果。predigeLabels {id} = tempseg;ID = ID + 1;结尾

处理测试卷1处理测试卷2处理测试卷3处理测试卷4处理测试卷5

与网络预测进行比较

选择一个测试图像以评估语义分割的准确性。从4-D体积数据中提取第一模态并将此3-D卷存储在变量中vol3d..

volId = 1;vol3d = {volId}卷(::,:,1);

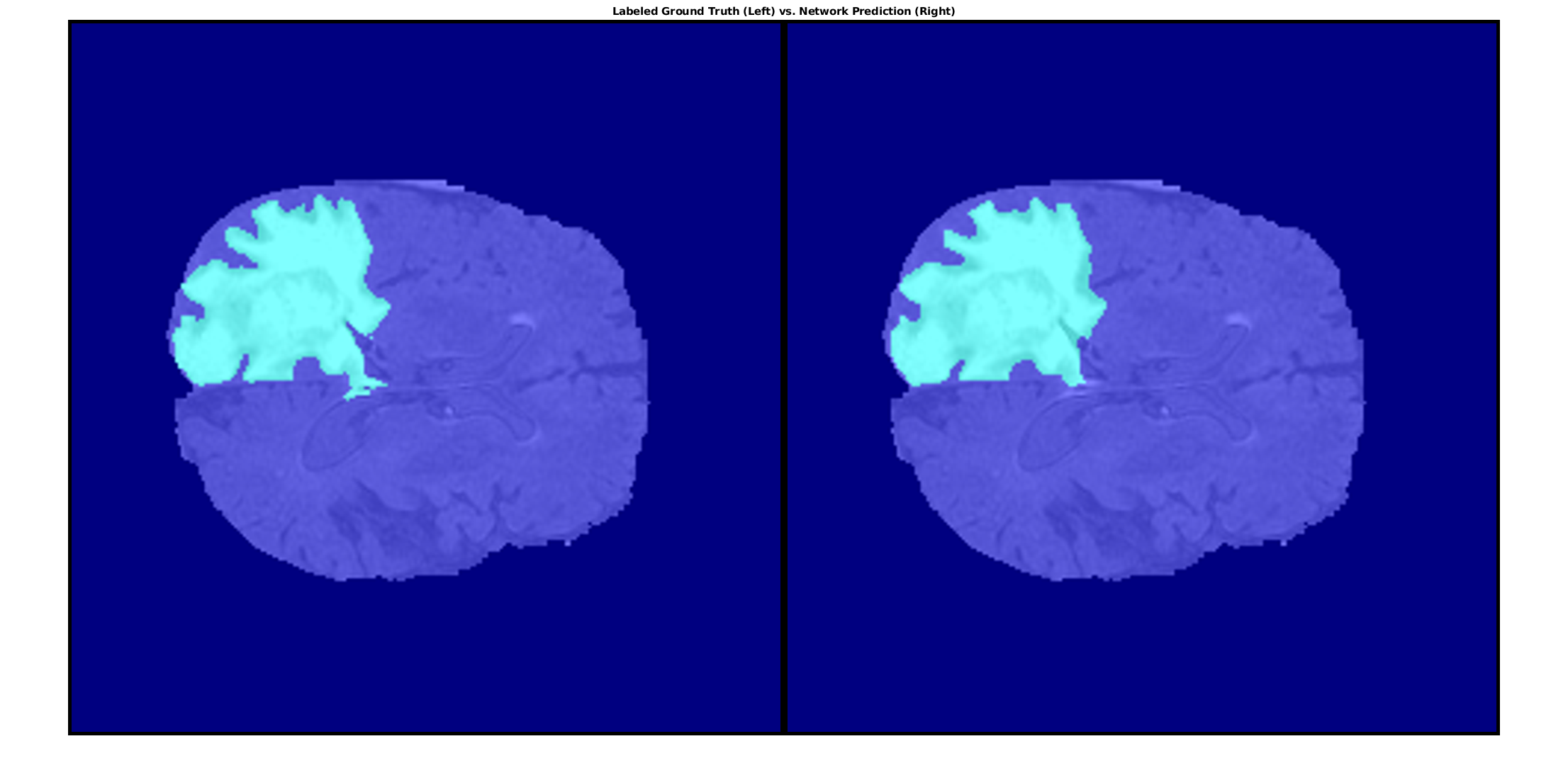

在蒙太奇中显示地面真理的中心切片和深度方向的预测标签。

ZID =尺寸(Vol3d,3)/ 2;zslicegt = labeloverlay(Vol3d(:,:,zid),地面标签{volid}(:,:,zid));zslicepred = labeloverlay(Vol3d(:,:,zid),predgedlabels {volid}(:,:,zid));图蒙太奇({zslicegt,zslicepred},“尺寸”(1 - 2),“BorderSize”5)标题('标记为基本真理(左)与网络预测(右)')

显示地面真相标记卷使用labelvolshow函数。通过设置背景标签的可见性来使后台完全透明(1)0..因为肿瘤位于脑组织内,使一些脑体素透明,因此肿瘤是可见的。要使一些脑体素透明,请将音量阈值指定为范围内的数字[0,1]。此阈值以下的所有归一化体积强度都是完全透明的。该示例将音量阈值设置为小于1,以便某些脑像素保持可见,以使上下文在大脑内部的肿瘤的空间位置。

ViewPnltruth = UIPanel(图,“标题”那'地面真理标有卷');hTruth=labelvolshow(groundTruthLabels{volId},vol3d,'父母',查看pnltruth,...'lablecolor',[0 0 0; 1 0 0],'volumethreshold', 0.68);hTruth.LabelVisibility (1) = 0;

对于相同的卷,显示预测的标签。

ViewPnlpred = Uipanel(图,“标题”那“预测标签卷”);hPred=labelvolshow(predictedLabels{volId},vol3d,'父母'viewPnlPred,...'lablecolor',[0 0 0; 1 0 0],'volumethreshold', 0.68);

hpred.Labelvisibility(1)= 0;

此图像显示在卷之一上顺序显示切片的结果。标记的地面真相位于左侧,网络预测位于右侧。

量化分割精度

利用骰子函数。该功能计算预测和地面事实分段之间的骰子相似度系数。

diceResult = 0(长度(voldsTest.Files), 2);为了j = 1:length(vol) dicerresult (j,:) = dice(groundTruthLabels{j},predictedLabels{j});结尾

计算该组测试卷的平均骰子分数。

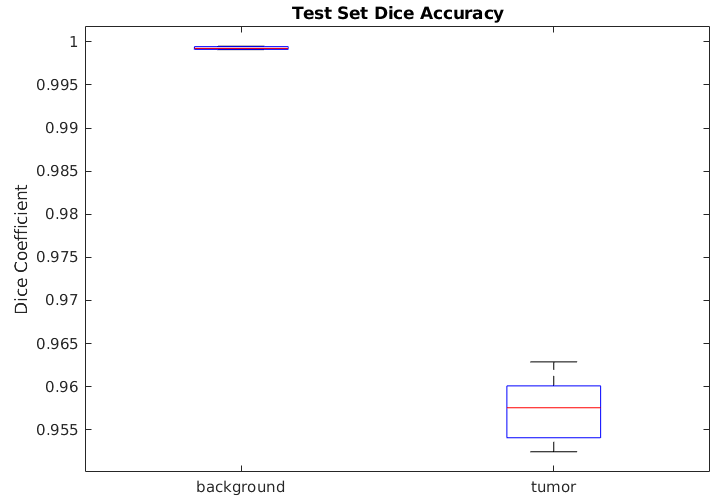

MeanDicebackground =卑鄙(DicEresult(:,1));DISP(['跨越背景的平均骰子分数'num2str (j),...‘测试卷’,num2str(背景)])

5个测试卷的平均骰子得分= 0.9993

平均值=平均值(结果(:,2));显示([“整个肿瘤的平均骰子分数”num2str (j),...‘测试卷’,num2str(meandicetumor)])

5个试验体积肿瘤的平均骰子得分= 0.9585

该图显示了一个箱形图(统计和机器学习工具箱)这将可视化五个样本测试卷集合中骰子分数的统计信息。图中的红线显示类的骰子中值。蓝色框的上限和下限分别表示第25个和第75个百分位。黑胡子延伸到最极端的数据点,不考虑异常值。

如果您有统计学和机器学习工具箱™,那么您可以使用箱形图在所有测试卷上可视化DICE分数的统计功能。创建一个箱形图,设置createBoxplot以下代码中的变量真正的.

createBoxplot = false;如果createBoxplot图形boxplot(dicerresult) title('测试设置骰子准确度')XTicklabels(ClassNames)Ylabel('骰子系数')结尾

参考文献

[1]Çiçek,Ö。,A. Abdulkadir,S. Lienkamp,T.Brox和O. Ronneberger。“3D U-Net:从稀疏注释学习密集的容积分割。”在国际医学图像计算和计算机辅助干预会议论文集- MICCAI 2016.希腊雅典,2016年10月,第424-432页。

Isensee, F., P. Kickingereder, W. Wick, M. Bendszus, K. H. Maier-Hein。脑肿瘤分割和放射组学生存预测:对BRATS 2017挑战的贡献在BrainLes会议录:国际MICCAI脑损伤研讨会加拿大魁北克市,2017年9月,第287-297页。

[3]“脑肿瘤”。医疗细分迪卡侬。http://medicaldecathlon.com/

BRATS数据集由医疗细分牌号提供CC-BY-SA 4.0许可证。所有保证和陈述都被忽视;有关详细信息,请参阅许可证。MathWorks®已修改链接的数据集下载佩带的网络和样本测试集这个例子的一部分。修改的样品数据集已经裁剪到主要是大脑和肿瘤的区域,并且通过减去裁剪脑区域的标准偏差来独立地归一化。

[4] Sudre,C.H.,W.LI,W.LI,T.Vercauteren,S. Ourselin和M. J. Cardoso。“广义骰子作为高度不平衡分割的深度学习损失函数重叠。”医学图像分析中的深度学习和临床决策支持的多模态学习:第三届国际研讨会金宝app加拿大魁北克市,2017年9月,第240-248页。

[5] U-Net:生物医学图像分割的卷积网络〉,载于国际医学图像计算与计算机辅助干预会议论文集- MICCAI 2015.慕尼黑,德国,2015年10月,第234-241页。可在Arxiv提供:1505.04597。

也可以看看

imageDatastore|随机抽取数据存储|变换|dicepixelclassificationlayer.(电脑视觉工具箱)|pixelLabelDatastore(电脑视觉工具箱)|SemanticSeg.(电脑视觉工具箱)|trainingOptions(深度学习工具箱)|Trainnetwork.(深度学习工具箱)