使用深度学习的图像处理操作员近似

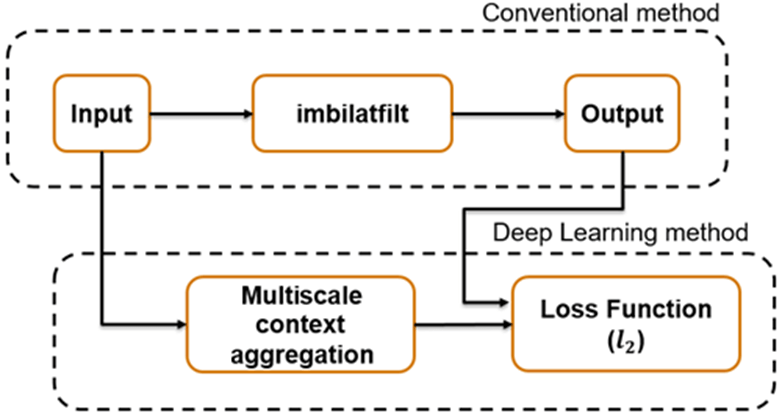

此示例显示如何使用多尺度上下文聚合网络(CAN)近似图像过滤操作。

操作员近似发现处理图像的替代方式,使得结果类似于传统图像处理操作或管道的输出。操作员近似的目标通常是减少处理图像所需的时间。

已经提出了几种经典和深度学习技术来执行操作员近似。一些经典技术提高了单个算法的效率,但不能推广到其他操作。另一种常用技术通过将操作员应用于图像的低分辨率副本来近似于广泛的操作,但是高频内容的损失限制了近似的准确性。

深度学习解决方案使得更常见和金宝搏官方网站复杂的操作近似。例如,Q. Chen呈现的MultiScale Context聚合网络(CAN)[1]可以近似多尺度色调映射,摄影风格传输,非局部去吸附和铅笔画。MultiScale可以在全分辨率图像上进行培训,以便在处理高频细节方面提高准确性。在培训网络之后,网络可以直接绕过传统的处理操作和处理图像。

此示例探讨如何训练多尺度才能近似双边图像过滤操作,这在保持边缘清晰度的同时降低图像噪声。该示例介绍了完整的培训和推理工作流程,包括创建培训数据存储的过程,选择培训选项,培训网络以及使用网络处理测试图像。

操作员近似网络

多尺度可以接受培训以最小化 使用多尺度上下文聚合处理输入图像之后的图像处理操作和网络响应之间的传统输出之间的损耗。多尺度上下文聚合在整个图像上寻找有关每个像素的信息,而不是将搜索限制到围绕像素的小邻域。

为帮助网络学习全球图像属性,MultiScale Can Cranturemally具有大型接收字段。第一个和最后一层具有相同的大小,因为操作员不应改变图像的大小。通过指数增加的尺度因子来扩张连续的中间层(因此罐的“MultiScale”性质)。扩张使得网络能够在各种空间频率下寻找空间分离的特征,而不会降低图像的分辨率。在每个卷积层之后,网络使用自适应归一化来平衡批量归一化的影响和近似操作员上的身份映射。

下载培训和测试数据

下载IAPR TC-12基准,其中包括20,000个仍然自然图像[2]。数据集包括人,动物,城市等照片。数据文件的大小为约1.8 GB。如果您不想下载培训网络所需的培训数据集,那么您可以通过键入加载预制途径加载('训练operatorlearning-epoch-181.mat');在命令行。然后,直接去使用MultiScale可以执行双边过滤近似在这个例子中的部分。

imagesdir = tempdir;URL_1 ='http://www-i6.informatik.rwth-aachen.de/imageClef/resources/iaprtc12.tgz';downloadiaprtc12data(URL_1,ImagesDir);

此示例列举了具有IAPRTC-12基准数据的小子集的网络。

trainimagesdir = fullfile(imagesdir,'iaprtc12'那'图片'那'39');exts = {'.jpg'那'.bmp'那'.png'};PristineImages = ImageageAtastore(TrainimagesDir,'fileextensions',exts);

列出培训图像的数量。

numel(pristineimages.files)

ans = 916.

准备培训数据

要创建培训数据集,请在原始图像中读取并写出已过滤的图像。过滤的图像存储在指定的目录中的磁盘上Preprocessdatadir.。

preprocessdatadir = [trainimagesdir filesep'preprocesseddataset'];

使用辅助功能Bilateralfilterdataset预处理培训数据。此函数附加到示例作为支持文件。金宝app

辅助功能为每个原始图像执行这些操作InneedImages.:

计算双侧过滤的平滑度。平滑过滤的图像会降低图像噪声。

使用双边滤波使用

imbilatfilt.。使用滤波图像将滤波图像保存到磁盘

IMWRITE.。

BilateralFilterdataset(PristineImages,Preprocessdatadir);

定义随机修补程序提取数据存储进行培训

使用随机修补程序提取数据存储来将培训数据送到网络。此数据存储区从包含网络输入和所需网络响应的两个图像数据存储中提取随机对应的补丁。

在此示例中,网络输入是原始图像pristineImages.。期望的网络响应是双边滤波后的处理图像。创建一个调用的图像数据存储bilatfilteredimages来自BilateLe过滤图像文件的集合。

BilatFilteredImages = ImageageAtastore(PreprocessDatadir,'fileextensions',exts);

创建一个RandompatchExtractionDatastore.从两个图像数据存储。指定256×256像素的补丁大小。指定 'patchesperimage.'在训练期间从每对图像中提取一个随机定位的补丁。指定一个迷你批量大小。

minibatchsize = 1;patchsize = [256 256];dstrain = randompatchExtractionDataStore(PristineImages,BilatFilteredImages,Patchsize,......。'patchesperimage',1);dstrain.minibatchsize = minibatchsize;

这RandompatchExtractionDatastore.在每次迭代时向网络提供迷你批次数据。在数据存储区上执行读取操作以探索数据。

InputBatch =读(DStrain);DISP(InputBatch)

InputImage EscanningIagage _________________ _________________ {256×256×3 uint8} {256×256×3 uint8}

设置MultiScale Can Payers

此示例定义了使用深度学习工具箱™的图层的MultiScale可以包括:

imageInputlayer.(深度学习工具箱)- 图像输入层Convolution2Dlayer.(深度学习工具箱)- 卷积神经网络的2D卷积层BatchnormalizationLayer.(深度学习工具箱)- 批量归一化层漏滤网(深度学习工具箱)- 泄漏整流线性单元层回归金属(深度学习工具箱)- 神经网络的回归输出层

添加了两个自定义比例图层以实现自适应批量归一化层。将这些图层连接为此示例的支持文件。金宝app

AdaptiveNormalizationMu.- 调整批量归一化分支强度的刻度层

AdaptivevenormalizationLambda.- 调整身份分支优势的刻度图层

第一层,imageInputlayer.,在图像修补程序上运行。补丁大小基于网络接收字段,其是影响网络中最顶层的响应的空间图像区域。理想情况下,网络接收字段与图像尺寸相同,以便它可以看到图像中的所有高级功能。对于双侧滤波器,近似图像贴片尺寸固定为256×256。

NetworkDepth = 10;Numberoffilters = 32;FirstLayer = imageInputLayer([256 256 3],'姓名'那'InputLayer'那'正常化'那'没有任何');

图像输入层之后是2-D卷积层,其包含32个尺寸3×3的滤波器。零焊接到每个卷积层的输入,以便特征映射保持与每个卷积后的输入相同的大小。将权重初始化为身份矩阵。

WGT =零(3,3,3,Numberoffilters);为了II = 1:3 WGT(2,2,i,II)= 1;结尾ConcutionLayer = Convolution2Dlayer(3,Numberoffilters,'填充',1,......'重量',WGT,'姓名'那'conv1');

每个卷积层后跟批量归一化层和调整批量归一化分支的强度的自适应归一化刻度层。稍后,此示例将创建调整身份分支的强度的相应自适应标准化刻度图层。现在,跟随AdaptiveNormalizationMu.层与加法层。最后,用标量乘法器指定泄漏的Relu层0.2对于负输入。

Batchnorm = BatchnormalizationLayer('姓名'那'bn1');AdaptiveMu = AdaptivevenorationMu(Numberoffilters,'mu1');AddLayer = AdgryLayer(2,'姓名'那'Add1');LeakeyLELLAYER =漏滤疹(0.2,'姓名'那'泄漏1');

按照相同模式指定网络的中间层。连续的卷积层具有扩张因子,其呈指数与网络深度指数。

middlayers = [卷积层Batchnorm AdaptiveMu Addlayer Leacerlayer];WGT =零(3,3,Numberoffilters,Numberoffilters);为了II = 1:Numberoffilters WGT(2,2,i,II)= 1;结尾为了LayerNumber = 2:NetworkDepth-2扩张物= 2 ^(Layernumber-1);padding =稀释剂;conv2dlayer = Convolution2dlayer(3,Numberoffilters,......'填充',填充,'膨胀因子',稀释物,......'重量',WGT,'姓名',['conv'num2str(layernumber)]);Batchnorm = BatchnormalizationLayer('姓名',['bn'num2str(layernumber)]);AdaptiveMu = AdaptiveverORMalizationMu(Numberoffilters,['亩'num2str(layernumber)]);AddLayer = AdgryLayer(2,'姓名',['添加'num2str(layernumber)]);LeakeyLELLAYER =漏滤疹(0.2,'姓名',['泄漏'num2str(layernumber)]);Middlelayers = [Middlayers Conv2Dlayer Batchnorm AdaptiveMu Addlayer Leacerullayer];结尾

不要将扩张因子施加到第二次卷积层。

conv2dlayer = Convolution2dlayer(3,Numberoffilters,......'填充',1,'重量',WGT,'姓名'那'conv9');Batchnorm = BatchnormalizationLayer('姓名'那'AN9');AdaptiveMu = AdaptivevenorationMu(Numberoffilters,'mu9');AddLayer = AdgryLayer(2,'姓名'那'Add9');LeakeyLELLAYER =漏滤疹(0.2,'姓名'那'泄漏9');Middlelayers = [Middlayers Conv2Dlayer Batchnorm AdaptiveMu Addlayer Leacerullayer];

最后一个卷积图层具有重建图像的1-×1-32-3的单个过滤器。

WGTS = SQRT(2 /(9 * Numberoffilters))* Randn(1,1,Numberoffilters,3);conv2dlayer = Convolution2dlayer(1,3,'numchannels',numperoffilters,......'重量',WGT,'姓名'那'conv10');

最后一层是回归层而不是泄漏的Relu层。回归层计算双边滤波图像和网络预测之间的平均平均误差。

finAllayers = [conv2dlayer回归层('姓名'那'finallegressionlayer')];

连接所有层。

图层= [FirstLayer Middlayers FinAllayers];Lgraph = LayerGraph(层);

创建跳过连接,充当自适应归一化方程的标识分支。将跳过连接连接到添加图层。

Skipconv1 = AdaptivevenalizationLambda(Numberoffilters,'lambda1');skipconv2 = AdaptivevenalizationLambda(Numberoffilters,'lambda2');skipconv3 = AdaptivevenalizationLambda(Numberoffilters,'lambda3');Skipconv4 = AdaptivevenalizationLambda(Numberoffilters,'lambda4');Skipconv5 = AdaptivevenalizationLambda(Numberoffilters,'lambda5');Skipconv6 = AdaptivevenalaizationLambda(Numberoffilters,'lambda6');Skipconv7 = AdaptivevenalizationLambda(Numberoffilters,'lambda7');Skipconv8 = AdaptivenormalizationLambda(Numberoffilters,'lambda8');Skipconv9 = AdaptiveVentalizationLambda(Numberoffilters,'lambda9');Lgraph = Addlayers(LGraph,Skipconv1);Lgraph = ConnectLayers(LAPHAGE,'conv1'那'lambda1');Lgraph = ConnectLayers(LAPHAGE,'lambda1'那'Add1 / In2');Lgraph = Addlayers(LGraph,Skipconv2);Lgraph = ConnectLayers(LAPHAGE,'conv2'那'lambda2');Lgraph = ConnectLayers(LAPHAGE,'lambda2'那'Add2 / In2');Lgraph = AddLayers(LGraph,Skipconv3);Lgraph = ConnectLayers(LAPHAGE,'conv3'那'lambda3');Lgraph = ConnectLayers(LAPHAGE,'lambda3'那'Add3 / In2');Lgraph = Addlayers(LGraph,SkipConv4);Lgraph = ConnectLayers(LAPHAGE,'conv4'那'lambda4');Lgraph = ConnectLayers(LAPHAGE,'lambda4'那'Add4 / In2');Lgraph = AddLayers(LGraph,Skipconv5);Lgraph = ConnectLayers(LAPHAGE,'conv5'那'lambda5');Lgraph = ConnectLayers(LAPHAGE,'lambda5'那'Add5 / In2');Lgraph = Addlayers(LGraph,SkipConv6);Lgraph = ConnectLayers(LAPHAGE,'conv6'那'lambda6');Lgraph = ConnectLayers(LAPHAGE,'lambda6'那'Add6 / In2');Lgraph = Addlayers(LGraph,SkipConv7);Lgraph = ConnectLayers(LAPHAGE,'conv7'那'lambda7');Lgraph = ConnectLayers(LAPHAGE,'lambda7'那'Add7 / In2');Lgraph = Addlayers(LGraph,Skipconv8);Lgraph = ConnectLayers(LAPHAGE,'conv8'那'lambda8');Lgraph = ConnectLayers(LAPHAGE,'lambda8'那'Add8 / In2');Lgraph = Addlayers(LGraph,Skipconv9);Lgraph = ConnectLayers(LAPHAGE,'conv9'那'lambda9');Lgraph = ConnectLayers(LAPHAGE,'lambda9'那'Add9 / In2');

绘制图层图。

图(LGROPL)

指定培训选项

使用ADAM Optimizer培训网络。通过使用使用upperdameter设置培训选项(深度学习工具箱)功能。使用默认值0.9为了 '势头' 和0.0001为了 'L2Regular化'(重量衰减)。指定常量学习率0.0001。训练181个时代。

maxepochs = 181;initLearningrate = 0.0001;minibatchsize = 1;选项=培训选项('亚当'那......'italllearnrate',initlearningrate,......'maxepochs',maxepochs,......'minibatchsize',小匹马,......'plots'那'培训 - 进步'那......'verbose',错误的);

训练网络

默认情况下,示例加载备份多尺度可以近似双边滤波器。佩带的网络使您可以执行双边过滤的近似,而无需等待培训完成。

要训练网络,请设置用圆形以下代码中的变量真的。培训多尺度可以使用的Trainnetwork.(深度学习工具箱)功能。

在GPU上培训如果有一个可用的。使用GPU需要并行计算工具箱™和启用CUDA®GPUNVIDIA®。有关更多信息,请参阅GPU通金宝app过发布支持(并行计算工具箱)。培训大约需要15个小时的NVIDIA™Titan X.

dotraining = false;如果dotrained modeldateTem = string(DateTime('现在'那'格式'那“yyyy-mm-dd-hh-mm-ss”));net = trainnetwork(Dstrain,Largrain,选项);保存(strcat(“训练的训练园林宁 - ”,modeldateTime,“-时代-”,num2str(maxepochs),“。垫”),'网');别的加载('训练有素的训练器inning-epoch-181.mat');结尾

使用MultiScale可以执行双边过滤近似

要使用培训的多尺度可以接近双边滤波器的网络来处理图像,请按照此示例的其余步骤操作。剩下的例子显示了如何:

从参考图像创建示例噪声输入图像。

使用嘈杂图像执行常规的双边滤波

imbilatfilt.功能。使用CAN对嘈杂图像进行双边滤波进行近似。

在视觉上比较操作员近似和传统双边滤波的去噪图像。

通过量化图像的相似性来评估去噪图像的质量来原始参考图像。

创建示例嘈杂的图像

创建一个示例嘈杂的图像,该图像将用于将操作员近似的结果与传统的双边滤波进行比较。测试数据集,testimages,包含在图像处理工具箱™中运输的21个原始图像。将图像加载到imageageAtastore.。

exts = {'.jpg'那'.png'};filenames = {'sherlock.jpg'那'car2.jpg'那'fabric.png'那'greens.jpg'那'hands1.jpg'那'kobi.png'那......'lighthouse.png'那'micromarket.jpg'那'Office_4.jpg'那'onion.png'那'pears.png'那'YellowLily.jpg'那......'印第安纳州jpg'那'flamingos.jpg'那'塞维利亚jpg'那'llama.jpg'那'Parkvenue.jpg'那......'peacock.jpg'那'car1.jpg'那'strawberries.jpg'那'wagage.jpg'};filepath = [fullfile(matlabroot,'工具箱'那'图片'那'imdata')FILESEP];filepathnames = strcat(filepath,文件名);testimages = imageageataStore(FilePathnames,'fileextensions',exts);

将测试图像显示为蒙太奇。

蒙太奇(Testimages)

选择其中一个图像用作双边滤波的参考图像。将图像转换为数据类型uint8.。

Indx = 3;从测试图像数据存储读取的图像索引Ireference = ReadImage(testimages,Indx);Ireference = IM2UINT8(IREREFICE);

您可以选择使用自己的图像作为参考图像。请注意,测试图像的大小必须至少为256〜256。如果测试图像小于256×256,则使用该测试图像增加图像尺寸imresize功能。网络还需要RGB测试图像。如果测试图像是灰度,请使用该测试图像将图像转换为RGB猫沿第三维度连接原始图像的三个副本。

显示参考图像。

imshow(启发)标题('原始参考图像')

使用imnoise.用于添加零表示高斯白噪声的功能,方差为0.00001到参考图像。

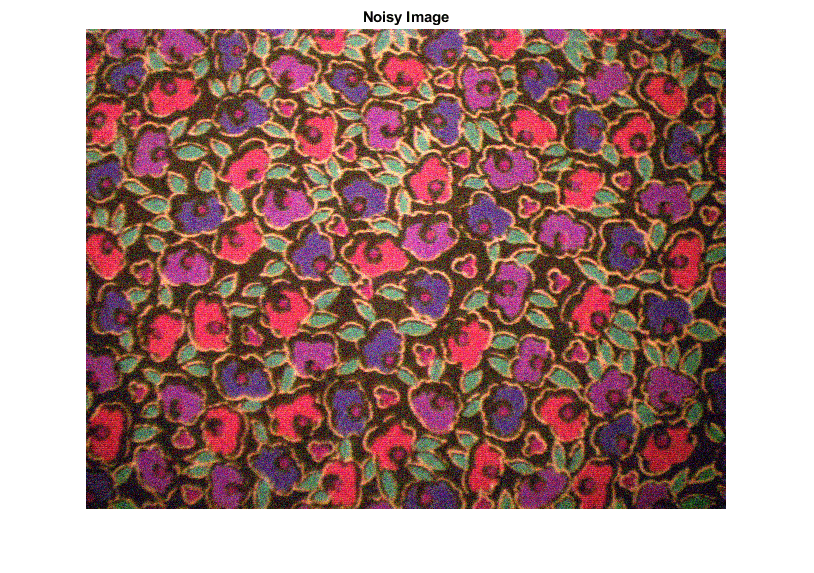

Inoisy = imnoise(Irecerence,'高斯',0.00001);imshow(Inoisy)标题('吵闹的形象')

使用双边滤波滤波图像

传统的双侧滤波是在保持边缘清晰度的同时降低图像噪声的标准方法。使用imbilatfilt.函数将双边滤波器应用于嘈杂的图像。指定平滑度等于像素值的方差。

学位= var(Double(Inoisy(:)));ibilat = imbilatfilt(Inoisy,steetofoothing);imshow(ibilat)标题('使用双侧过滤获得的去噪图像')

使用培训的网络处理图像

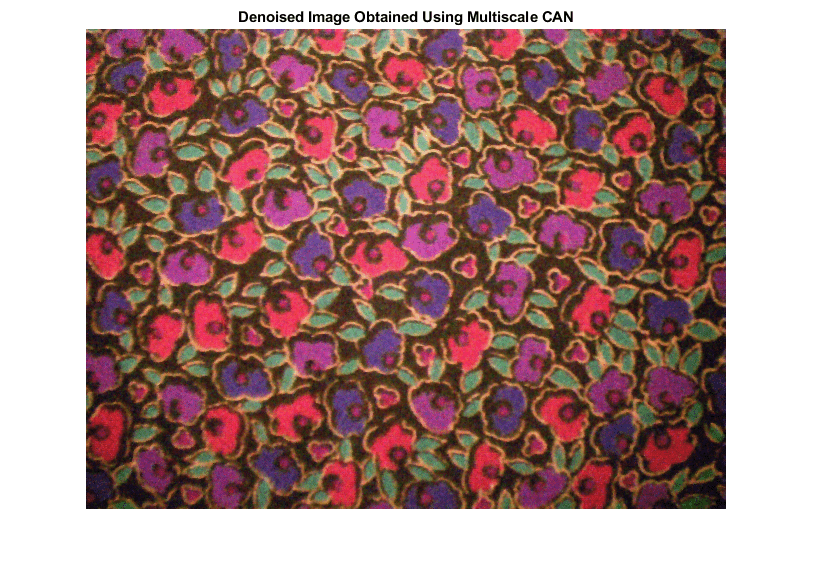

通过训练网络通过归一化输入图像并观察激活(深度学习工具箱)来自最终层(回归层)。网络的输出是所需的去噪图像。

iapprox =激活(网络,Inoisy,'finallegressionlayer');

图像处理工具箱™需要浮点图像在范围内具有像素值[0,1]。使用rescale.函数要将像素值缩放到此范围,然后将图像转换为uint8.。

IAPPROX = RESCALE(IAPPROX);Iapprox = im2uint8(Iapprox);imshow(iapprox)标题('使用MultiScale获得的去噪图像可以')

视觉和定量比较

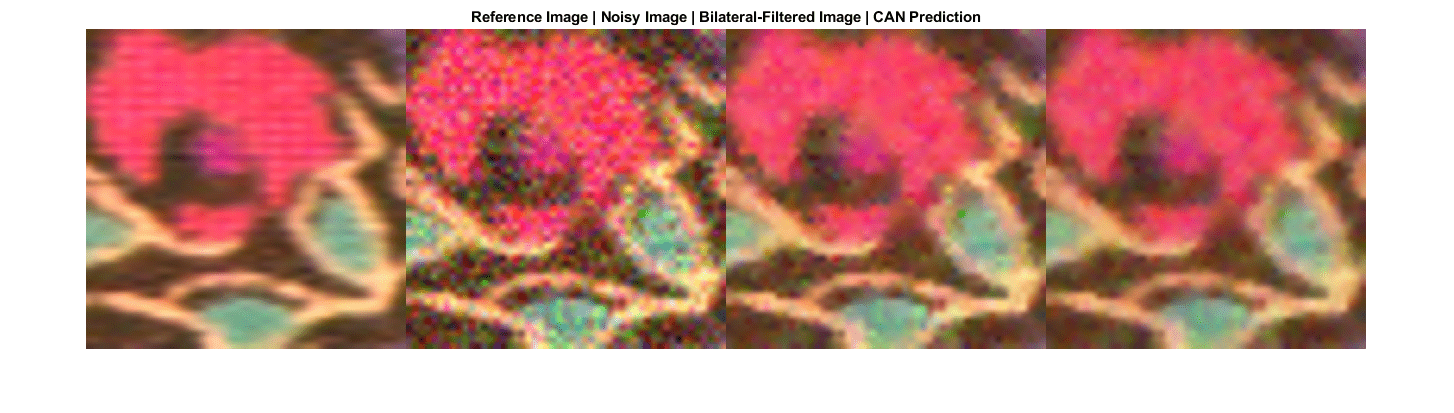

为了更好地了解去噪图像,检查每个图像内的一个小区域。使用载体指定感兴趣区域(ROI)ROI.格式[Xy宽度高度]。元素定义左上角的X和Y坐标,以及ROI的宽度和高度。

ROI = [300 30 50 50];

将图像裁剪到此ROI,并将结果显示为蒙太奇。

蒙太奇({imcrop(Irecerence,Roi),Imcrop(Inoisy,Roi),......Imcrop(Ibilat,ROI),IMCROP(IAPPROX,ROI)},......'尺寸',[1 4]);标题('参考图像|嘈杂的图像|双侧过滤图像|可以预测');

可以去除比传统的双边滤波更多的噪声。这两种技术都保留了边缘清晰度。

使用图像质量指标来定量地比较嘈杂的输入图像,双边滤波图像和操作员近似图像。参考图像是原始参考图像,启动,在添加噪音之前。

根据参考图像测量每个图像的峰值信噪比(PSNR)。较大的PSNR值通常表示更好的图像质量。看PSNR.有关此度量标准的更多信息。

noisypsnr = psnr(Inoisy,Itriference);bilatpsnr = psnr(ibilat,i reference);大约= PSNR(IAPPROX,ISPERFERGE);DISP(['PSNR:嘈杂的图像/双边滤波图像/操作员近似图像='那......num2str([noisypsnr bilatpsnr大约净值])])

PSNR:嘈杂图像/双侧过滤图像/操作员近似图像= 20.2857 25.7978 26.2011

测量每个图像的结构相似索引(SSIM)。SSIM评估图像的三种特征的视觉影响:亮度,对比度和结构,对参考图像。SSIM值越靠近1,测试图像与参考图像相一致越好。看SSIM有关此度量标准的更多信息。

noisyssim = ssim(Inoisy,Itriference);Bilatssim = SSIM(Ibilat,Ireference);informssim = ssim(iapprox,启动);DISP(['SSIM:嘈杂的图像/双边滤波图像/操作员近似图像='那......num2str([noisyssim bilatssim aquousssim])])

SSIM:嘈杂图像/双侧过滤图像/操作员近似图像= 0.76251 0.91576 0.92663

使用自然图像质量评估器(NIQE)测量感知图像质量。较小的NIQE评分表示更好的感知质量。看Niqe.有关此度量标准的更多信息。

noisyniqe = niqe(Inoisy);bilatniqe = niqe(ibilat);大约= niqe(iapprox);DISP(['NIQE得分:嘈杂的图像/双边过滤图像/操作员近似图像='那......num2str([noisyniqe bilatniqeiqueniqiqe])])

NIQE评分:噪声图像/双侧过滤图像/操作员近似图像= 12.1865 7.22606 6.18105

与传统的双侧滤波相比,操作员近似产生更好的度量分数。

参考

[1]陈,Q. J.Xu和V. koltun。“具有全卷积网络的快速图像处理。”在2017年IEEE会议上的计算机愿景会议。威尼斯,意大利,2017年10月,第2516-2525。

[2] Grubinger,M.,P. Clough,H.Müller和T. Deselaers。“IAPR TC-12基准测试:用于视觉信息系统的新评估资源。”基于内容的图像检索的odimage 2006语言资源的程序。热那亚,意大利。卷。5,2006年5月,p。10。

也可以看看

imbilatfilt.|RandompatchExtractionDatastore.|激活(深度学习工具箱)|分层图(深度学习工具箱)|培训选项(深度学习工具箱)|Trainnetwork.(深度学习工具箱)

相关话题

- 深度学习的预处理图像(深度学习工具箱)

- 深入学习的数据购物(深度学习工具箱)

- 深度学习层名单(深度学习工具箱)